Einführung des Qwen2 KI-Modells von Alibaba Cloud: Verbesserte Leistung und Unterstützung für 128K Token in der Verarbeitung langer Kontexte

Most people like

Entfessle atemberaubende, von KI generierte Kunstwerke für deine TTRPG- und D&D-Charaktere. Verwandle deine fantasievollen Kreationen in beeindruckende visuelle Meisterwerke!

Wir präsentieren ein KI-unterstütztes generatives UI-System, das darauf abzielt, die Nutzererfahrung zu revolutionieren. Diese innovative Technologie nutzt die Kraft der künstlichen Intelligenz, um dynamische, anpassungsfähige Benutzeroberflächen zu schaffen, die sich an individuelle Bedürfnisse und Vorlieben anpassen. Entdecken Sie, wie unser generativer Ansatz die Designeffizienz steigert und die Interaktionsqualität erhöht.

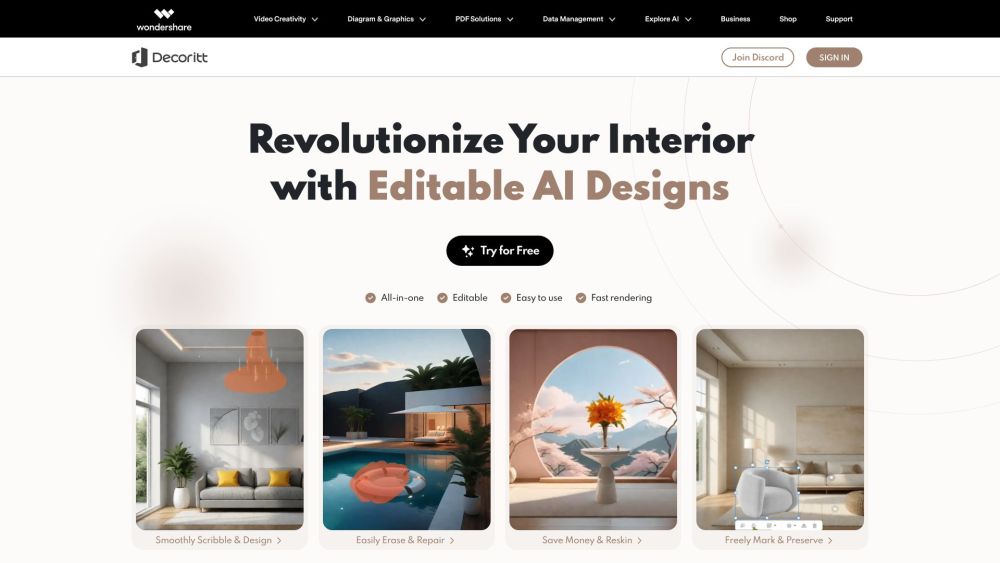

Entdecken Sie die Zukunft des Innendesigns mit unserer innovativen AI-Home-Design-Plattform. Dieses leistungsstarke Tool nutzt die neuesten Fortschritte in der künstlichen Intelligenz, um Ihnen zu helfen, mühelos Ihre Traummieträume zu gestalten und zu visualisieren. Egal, ob Sie ein professioneller Designer oder ein DIY-Enthusiast sind, unsere Plattform bietet maßgeschneiderte Lösungen, die Ihren einzigartigen Stil und Ihre Bedürfnisse erfüllen. Mit intuitiven Funktionen und intelligenten Designempfehlungen war es noch nie so einfach und erfreulich, Ihr Zuhause zu transformieren. Begleiten Sie uns, während wir erkunden, wie unsere KI-Technologie Ihre Herangehensweise an das Wohndesign neu definieren kann.

Find AI tools in YBX