Elon Musk stellt den leistungsstärksten KI-Trainingscluster der Welt vor

Most people like

Super Teacher bietet unbegrenzte private Nachhilfestunden in einer Vielzahl von Fächern für Kinder im Alter von 3 bis 8 Jahren und erzielt deutlich bessere Ergebnisse im Vergleich zu herkömmlicher Nachhilfe.

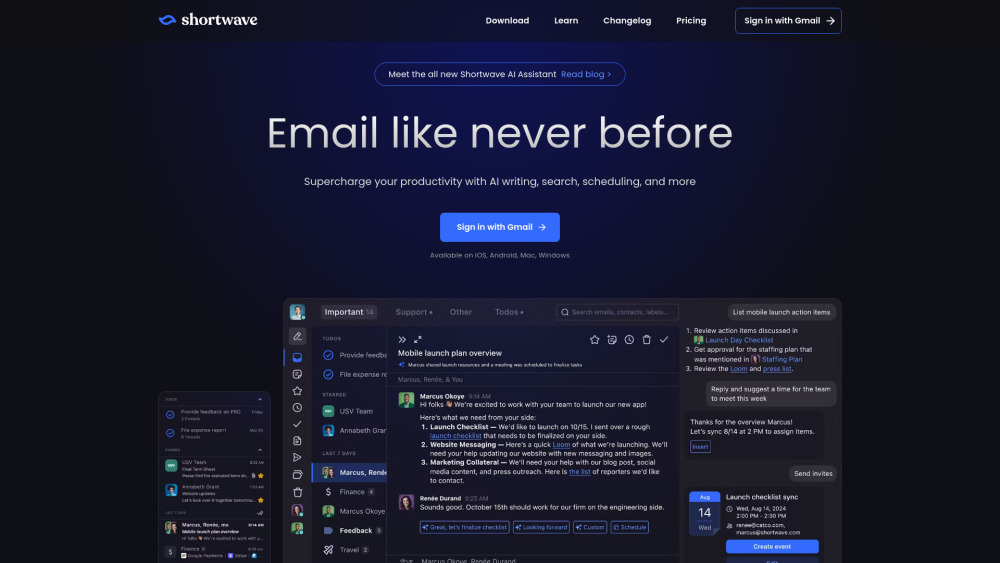

Revolutionieren Sie Ihr E-Mail-Management und steigern Sie Ihre Produktivität mit unserem fortschrittlichen KI-unterstützten Tool. Diese innovative Lösung optimiert Ihren Posteingang, priorisiert Ihre Nachrichten und hilft Ihnen, organisiert zu bleiben, sodass Sie niemals wieder eine wichtige E-Mail verpassen. Erleben Sie eine intelligenteren Weg, Ihre E-Mails zu verwalten und verbessern Sie noch heute Ihre Effizienz!

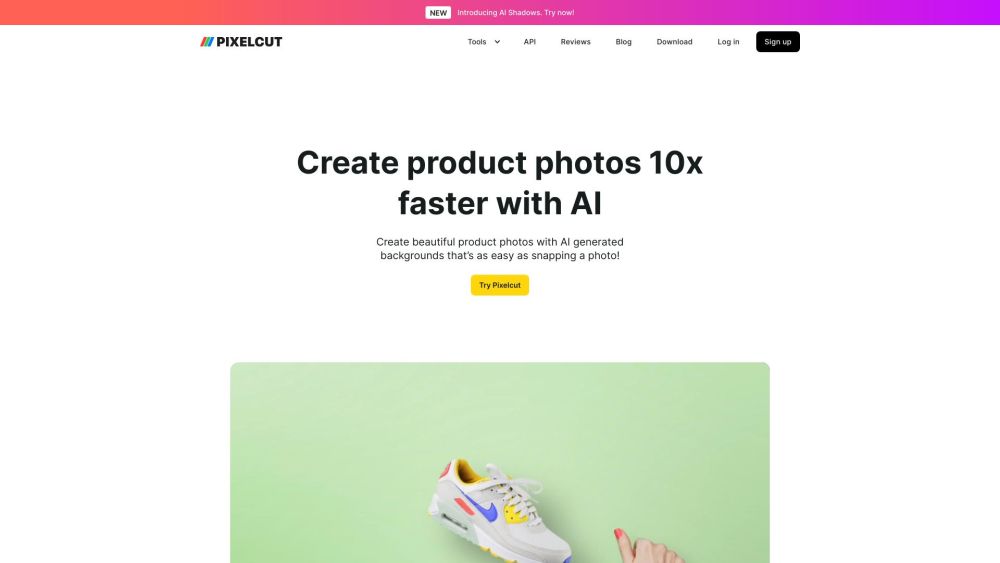

Entdecken Sie ein kostenloses Online-Designtool, ideal zum Erstellen beeindruckender Produktfotos und Werbung. Genießen Sie mühelose Funktionen zum Entfernen von Hintergründen und Objekten, um Ihre visuellen Inhalte mühelos zu verbessern.

Find AI tools in YBX

Related Articles

Refresh Articles