Groqs Open-Source Llama KI-Modell übertrifft GPT-4o und Claude bei der Funktionsausführung und sichert sich den ersten Platz auf der Rangliste.

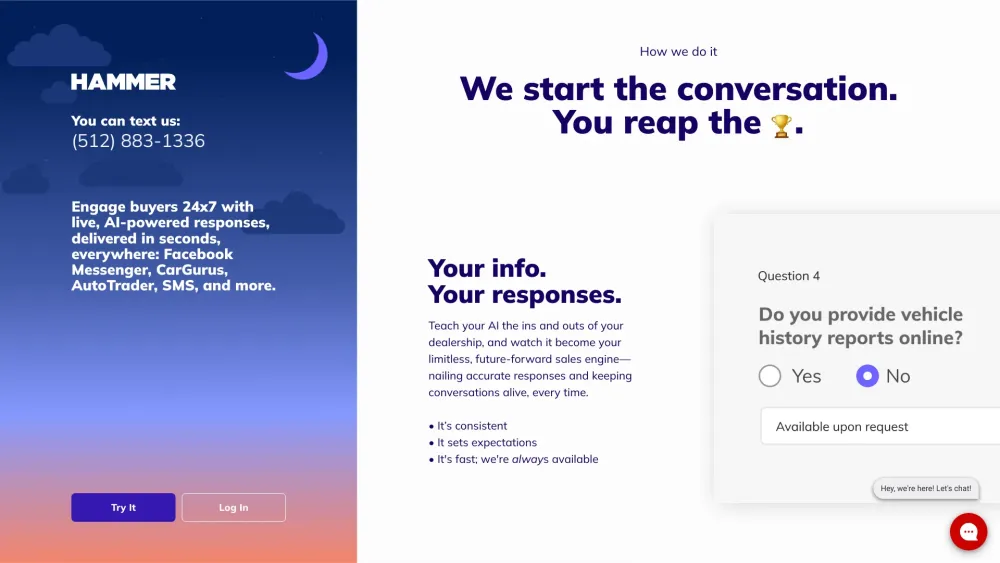

Most people like

Revolutionieren Sie Ihr Präsentationserlebnis mit KI-gestützten Tools, die es Ihnen ermöglichen, beeindruckende Folien in nur wenigen Sekunden zu erstellen. Verabschieden Sie sich von mühsamem Design und begrüßen Sie mühelose Präsentationen, die die Aufmerksamkeit Ihres Publikums fesseln. Nutzen Sie die Zukunft der Präsentationserstellung mit Technologien, die Ihren Arbeitsablauf optimieren und Ihre Botschaft verstärken.

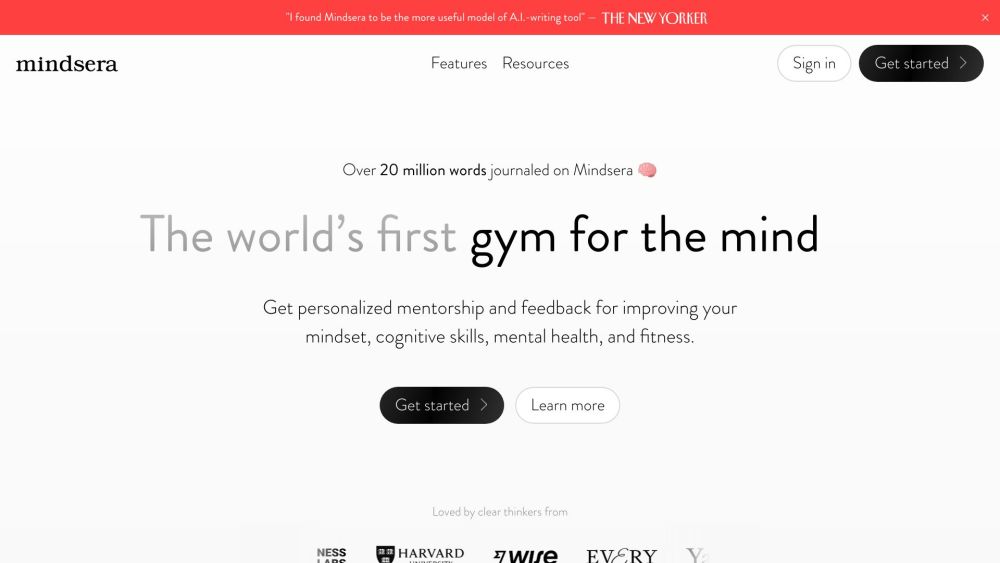

Präsentation des weltweit ersten KI-gesteuerten Journals: eine bahnbrechende Innovation, die unsere Art und Weise, Gedanken, Ideen und Erfahrungen festzuhalten, revolutioniert. Dieses hochmoderne Werkzeug nutzt künstliche Intelligenz, um Selbstreflexion zu fördern, die Organisation zu optimieren und Ihre Journaling-Reise zu personalisieren. Entdecken Sie, wie dieses revolutionäre Journal Ihre tägliche Schreibpraxis verbessern und Ihr psychisches Wohlbefinden unterstützen kann.

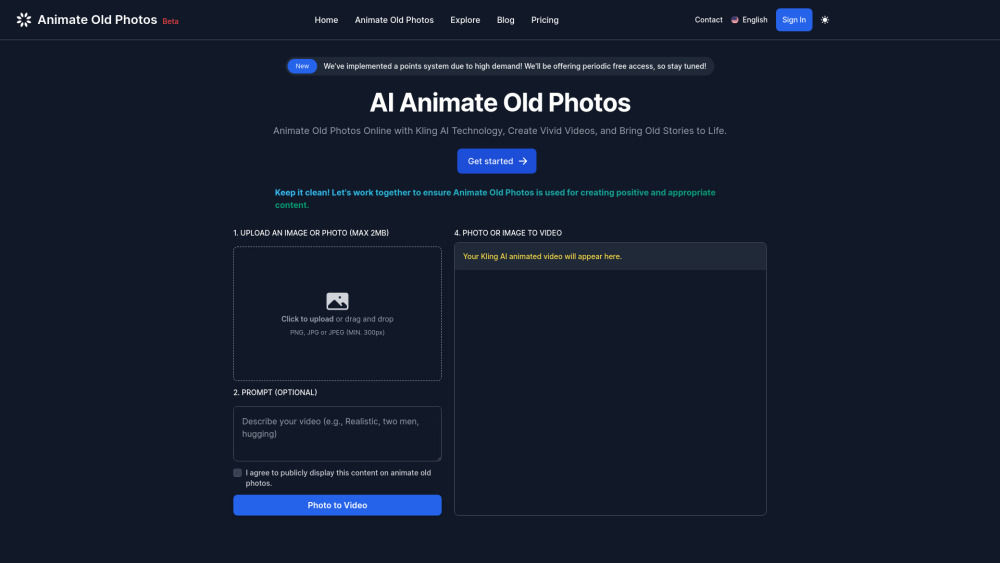

Verwandlung alter Fotos in fesselnde Videos mit KI-Tools

Im digitalen Zeitalter war es nie einfacher, kostbare Erinnerungen neu zu beleben. KI-Tools zur Animation alter Fotos in dynamische Videos ermöglichen es, vergangene Momente auf fesselnde Weise wieder zu erleben. Durch den Einsatz fortschrittlicher Technologie verbessern diese Tools Standbilder, indem sie mit Bewegung und Ton zum Leben erweckt werden. Entdecken Sie, wie Sie KI nutzen können, um Ihre historischen Fotos in teilenswerte Videostücke zu verwandeln, die Aufmerksamkeit erregen und Nostalgie wecken.

Find AI tools in YBX

Related Articles

Refresh Articles