Ist ein Chevy für 1 Dollar möglich? Die Risiken von KI-Chatbots im Kundenservice der Automobilbranche 조사하기

Most people like

Steigern Sie Ihre Produktivität mit AI Copilot

Entdecken Sie, wie AI Copilot Ihren Arbeitsablauf verändern und die Effizienz maximieren kann. Dieses leistungsstarke Tool vereinfacht Aufgaben und hilft Ihnen, mehr in kürzerer Zeit zu erreichen, während es Zusammenarbeit und Kreativität fördert. Nutzen Sie die Zukunft der Produktivität und entfalten Sie Ihr volles Potenzial mit AI Copilot noch heute!

Glasp ist ein innovativer sozialer Web-Highlighter, der darauf abzielt, Benutzern zu helfen, ihre hervorgehobenen Inhalte nahtlos zu organisieren und zu teilen. Durch die Veränderung Ihrer Interaktion mit Online-Informationen erleichtert Glasp die Verbindung zu anderen, während Sie Ihre Highlights effektiv verwalten.

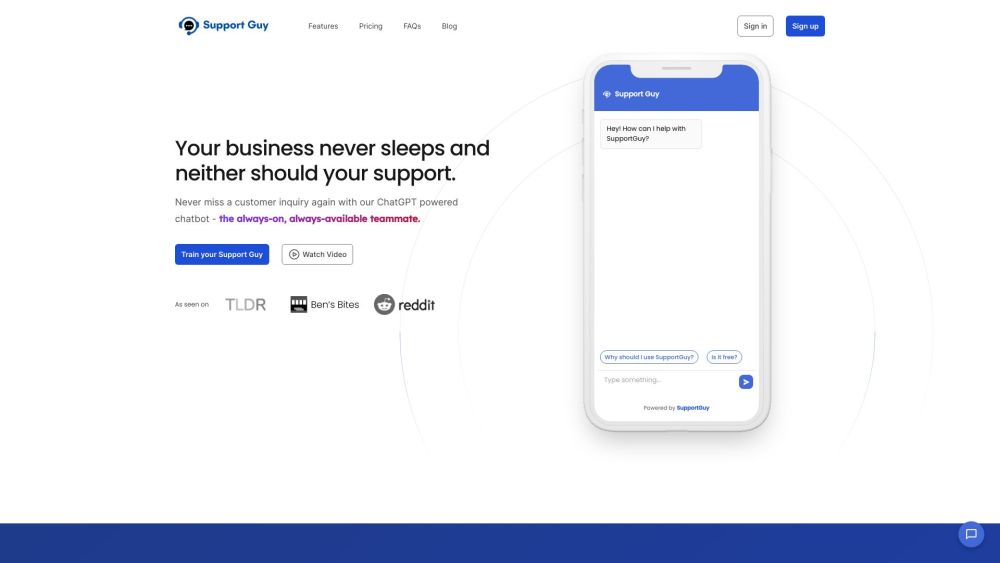

Die Transformation des Kundenservices: Der KI-gesteuerte ChatGPT von SupportGuy beantwortet rund um die Uhr Kundenanfragen. Genießen Sie jederzeit und überall nahtlose Unterstützung mit dieser fortschrittlichen Lösung.

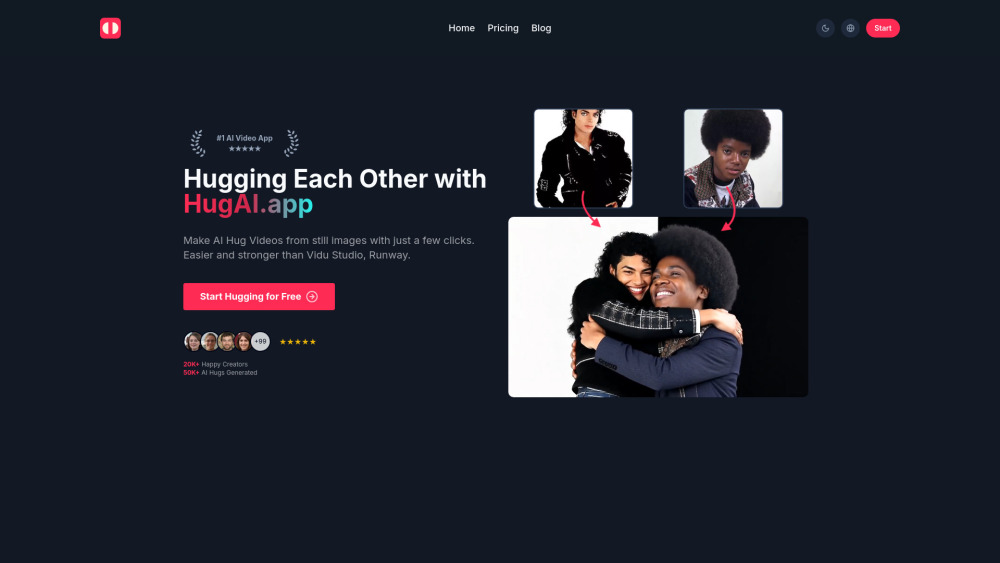

Präsentation eines innovativen KI-Tools, das Ihre geschätzten Fotos in herzerwärmende Umarmungsvideos verwandelt. Diese benutzerfreundliche Plattform erweckt Ihre Erinnerungen zum Leben und ermöglicht es Ihnen, Liebe und Unterstützung auf eine einzigartige Weise durch personalisierte visuelle Erzählungen auszudrücken. Erstellen Sie mühelos berührende Umarmungsvideos und teilen Sie Freude mit Ihren Liebsten!

Find AI tools in YBX

Related Articles

Refresh Articles