Nach nur zwei Monaten in der Vorschau freut sich Stability AI, sein nächstes Generationenmodell Stable Diffusion 3 der generativen KI zu präsentieren, zusammen mit einer frühen Vorschau auf die innovative Chatbot-Technologie „Stable Assistant“.

Ursprünglich im Februar als Vorschau angekündigt, ist Stable Diffusion 3 jetzt über eine API auf der Entwicklerplattform von Stability AI zugänglich. Diese API ermöglicht die einfache Integration der leistungsstarken Text-zu-Bild-Generierungsfunktionen des Modells in verschiedene Dienste und Anwendungen. Zusätzlich wurde eine Turbo-Variante – Stable Diffusion 3 Turbo – für verbesserte Performance eingeführt.

Mit Stable Diffusion 3 setzt Stability AI fortschrittliche maschinelle Lerntechniken ein, um die Bild- und Typografiequalität erheblich zu steigern. Ein zentrales Anliegen bei der API-Veröffentlichung war es, sicherzustellen, dass das Modell für den Produktionseinsatz bereit ist.

„Wir haben zahlreiche Sicherheitsmaßnahmen implementiert, um Missbrauch von SD3 zu verhindern, und verbessern diese kontinuierlich basierend auf dem Feedback der Nutzer“, sagte Christian Laforte, CTO und interimistischer Co-CEO von Stability AI.

Open Model Kommt Bald

Während Stable Diffusion 3 jetzt über die API verfügbar ist, wird ein offenes Modell noch vorbereitet. „Wir werden das Modell kontinuierlich verbessern, bevor es öffentlich freigegeben wird“, betonte Laforte. „Im Einklang mit unserem Engagement für offene generative KI werden wir bald die Modellgewichte für das Selbst-Hosting über eine Stability AI Mitgliedschaft zur Verfügung stellen.“

Diese Mitgliedschaftsstrategie, die erstmals im Dezember angekündigt wurde, zielt darauf ab, ein neues Einnahmemodell für das Unternehmen zu etablieren.

Partnerschaft mit Fireworks Verbessert API-Performance

Die Partnerschaft von Stability AI mit Fireworks AI wird die Leistung der Stable Diffusion 3 API steigern. Die Optimierung des API-Inferenz für generative KI-Anwendungen, insbesondere in großem Maßstab, kann komplex sein, aber die Expertise von Fireworks AI im Bereich maschineller Lernkompiler wird helfen, diese Herausforderungen zu meistern.

„Fireworks AI sind branchenführende Experten für ML-Compiler, ein entscheidender Bestandteil zur Optimierung der Inferenzgeschwindigkeit unserer Modelle“, bemerkte Laforte. „Die Zusammenarbeit mit ihnen ermöglicht es uns, die schnellste und zuverlässigste API-Plattform für Unternehmen auf dem Markt anzubieten.“

Innovationen in Stable Diffusion 3

Im Zentrum von Stable Diffusion steht das Diffusionsmodell, dessen Fähigkeiten durch mehrere Innovationen verbessert wurden. Besonders hervorzuheben ist die Einführung der Multimodal Diffusion Transformer (MMDiT)-Architektur, die das Textverständnis und die Typografiegenauigkeit optimiert.

Für das SD3-Turbo-Modell, das schnellere Ergebnisse liefert, wird eine neuartige Methode namens Latent Adversarial Diffusion Distillation (LADD) eingesetzt. „Im Wesentlichen ist SD3-Turbo bis zu 10 Mal schneller als SD3 und produziert Bilder von nahezu gleicher Qualität“, erklärte Laforte.

Vorstellung von Stable Assistant

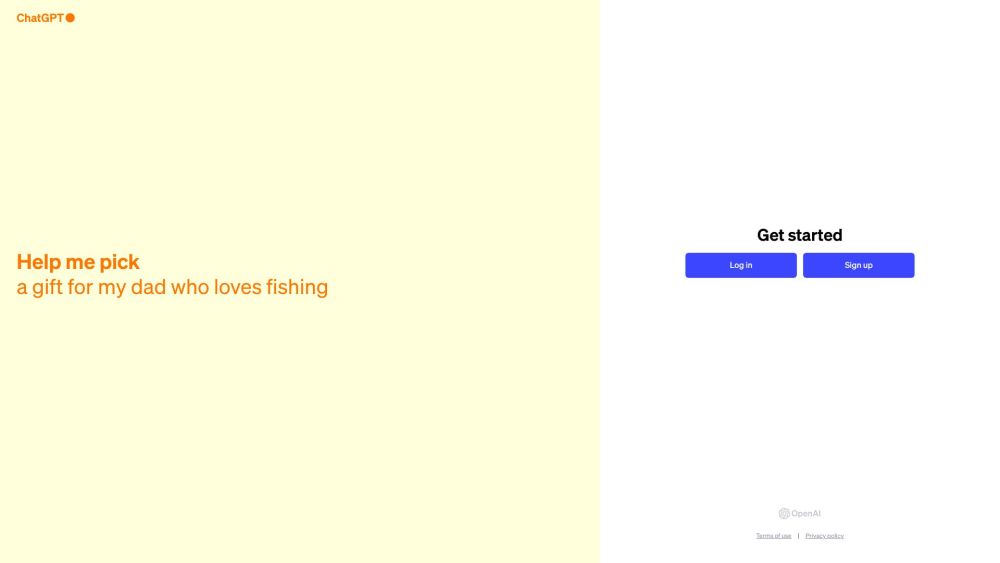

Neben dem neuen Stable Diffusion Modell hat Stability AI eine frühe Beta-Version von Stable Assistant vorgestellt, einem Chatbot, der auf der Text- und Bildgenerierungstechnologie des Unternehmens basiert. Ähnlich wie die Integration von OpenAI's ChatGPT Plus mit DALL-E 3 ermöglicht Stable Assistant die Bilderzeugung durch Konversation.

Laforte beschreibt Stable Assistant als benutzerfreundlichen Chatbot, der die Fähigkeiten von Stable Diffusion 3 und Stable LM 2 12B, das kürzlich veröffentlicht wurde, kombiniert. Dieses Tool generiert nicht nur Bilder aus Diskussionen, sondern bietet auch informative Antworten, unterstützt bei Schreibprojekten und bereichert Inhalte mit relevanten Bildern.

„Stable Assistant soll unser multimodaler Chatbot werden, der Zugriff auf all unsere Modelle und API-Dienste bietet, ohne dass technische Kenntnisse erforderlich sind“, erklärte Laforte. „Wir planen, seine Fähigkeiten weiter zu verbessern, indem wir Bildbearbeitung hinzufügen und Modelle aus anderen Modalitäten wie Video, 3D, Audio und Code integrieren.“