OpenAI y Anthropic instan al gobierno de EE. UU. a priorizar la evaluación de riesgos de nuevos modelos de IA.

Most people like

Descubre el potencial de la optimización de calendarios impulsada por IA para una experiencia laboral más flexible y enfocada. Agiliza tu horario, mejora la productividad y maximiza tu tiempo con soluciones de programación inteligentes diseñadas para satisfacer las demandas de tu flujo de trabajo dinámico.

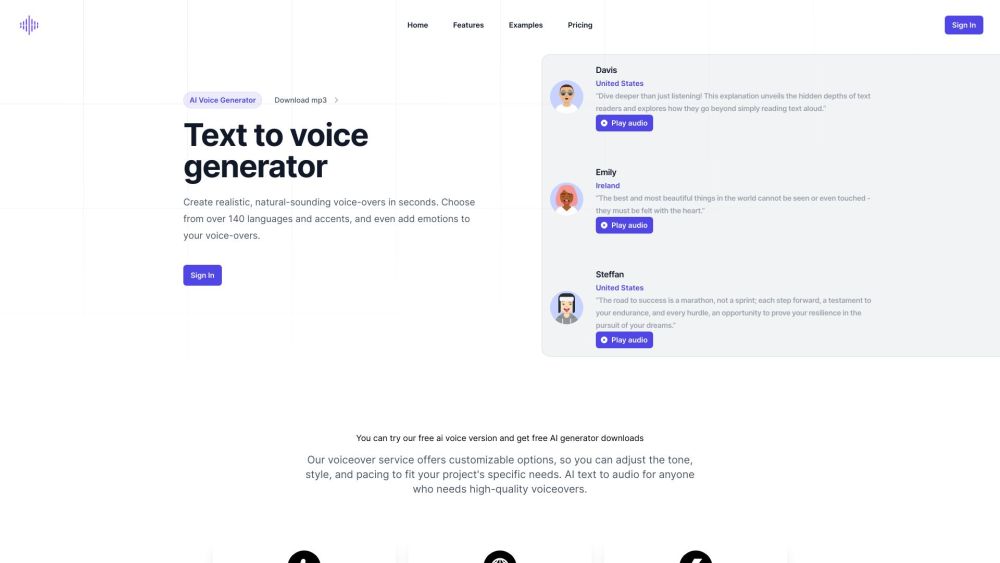

Convierte texto a voz de manera sencilla con nuestro avanzado generador de voz AI. Disfruta de audio natural y mejora tu contenido hoy mismo.

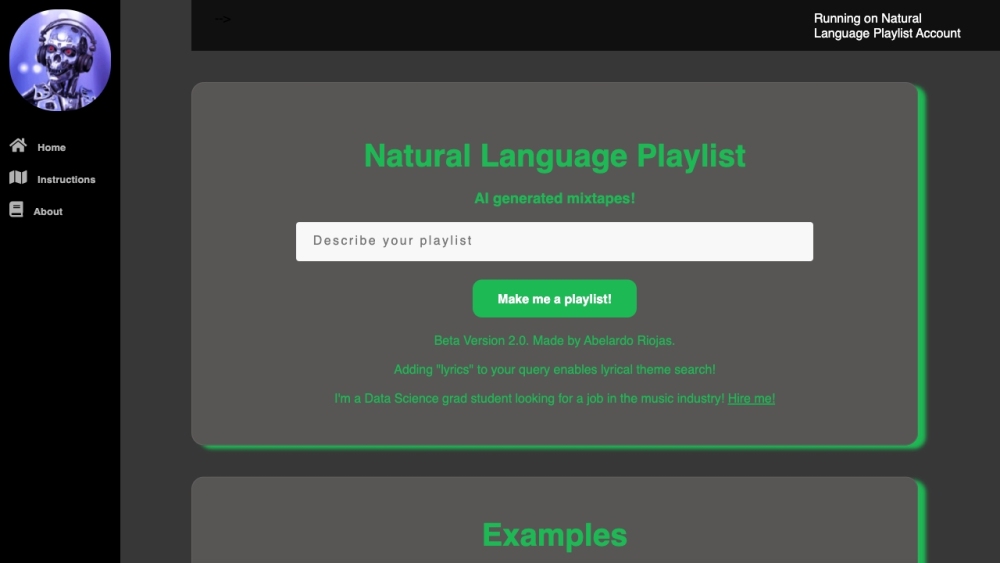

Descubre una innovadora plataforma de IA que crea mixtapes personalizados basados en tus descripciones únicas en lenguaje natural. Esta avanzada tecnología transforma tus palabras en una experiencia musical a medida, diseñada exclusivamente para ti.

Find AI tools in YBX

Related Articles

Refresh Articles