GamesBeat Summit 2024 : Tirer parti de l'IA pour renforcer la sécurité des joueurs dans le jeu vidéo

Most people like

Découvrez une plateforme marketing tout-en-un conçue pour automatiser vos tâches, optimiser vos workflows et améliorer l'engagement client sans effort. Idéale pour les entreprises en quête d'efficacité, cette solution complète simplifie vos efforts marketing tout en maximisant votre impact.

Upscalepics est un outil en ligne gratuit conçu pour améliorer et manipuler les images avec facilité et précision. Idéal pour quiconque souhaite améliorer la qualité d'image, cette plateforme conviviale propose des fonctionnalités puissantes pour des transformations visuelles époustouflantes.

Découvrez une plateforme d'IA révolutionnaire conçue pour transformer et optimiser votre processus de recherche. Vivez une efficacité et une précision sans précédent en utilisant la puissance de l'intelligence artificielle pour améliorer vos capacités de recherche. Découvrez comment notre technologie innovante peut soutenir votre quête de connaissance, rendant la collecte d'informations plus rapide et plus efficace que jamais.

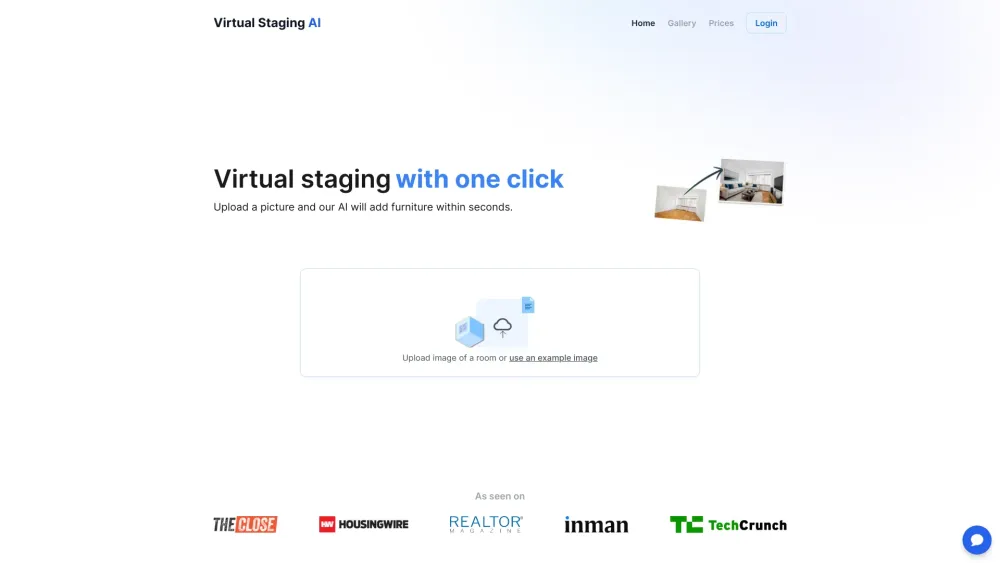

Transformez vos annonces grâce à notre application de mise en scène virtuelle alimentée par l'IA pour les professionnels de l'immobilier

Découvrez comment notre application innovante de mise en scène virtuelle basée sur l'IA peut rehausser vos annonces immobilières. Conçu spécifiquement pour les professionnels de l'immobilier, cet outil puissant vous permet de créer des visuels époustouflants et réalistes qui captivent les acheteurs potentiels et améliorent l'attrait des propriétés. Optimisez votre stratégie marketing et démarquez-vous sur un marché concurrentiel grâce à notre technologie de pointe conçue pour simplifier votre processus de présentation des biens.

Find AI tools in YBX