Mistral lance le Mixtral 8x22B : une domination sur le paysage de l'IA open source en France.

Most people like

Découvrez un assistant IA conçu spécialement pour la gestion des médias sociaux. Cet outil innovant simplifie votre flux de travail créatif et améliore votre processus de création de contenu. Transformez votre manière d'interagir avec votre audience et élevez votre stratégie sur les réseaux sociaux en toute simplicité.

Dans le paysage numérique rapide d’aujourd’hui, les agents de service client jouent un rôle essentiel dans la satisfaction des clients. Cependant, mener à bien des requêtes complexes peut être difficile sans support immédiat. Notre plateforme de guidance en temps réel renforce les centres de contact en fournissant aux agents une assistance instantanée et contextuelle, garantissant ainsi des réponses précises et rapides. En s'appuyant sur des analyses avancées et des insights basés sur l'IA, cette plateforme améliore la performance des agents, optimise les interactions avec les clients et, en fin de compte, accroît la productivité globale de votre centre de contact. Découvrez dès aujourd’hui l’avenir du service client !

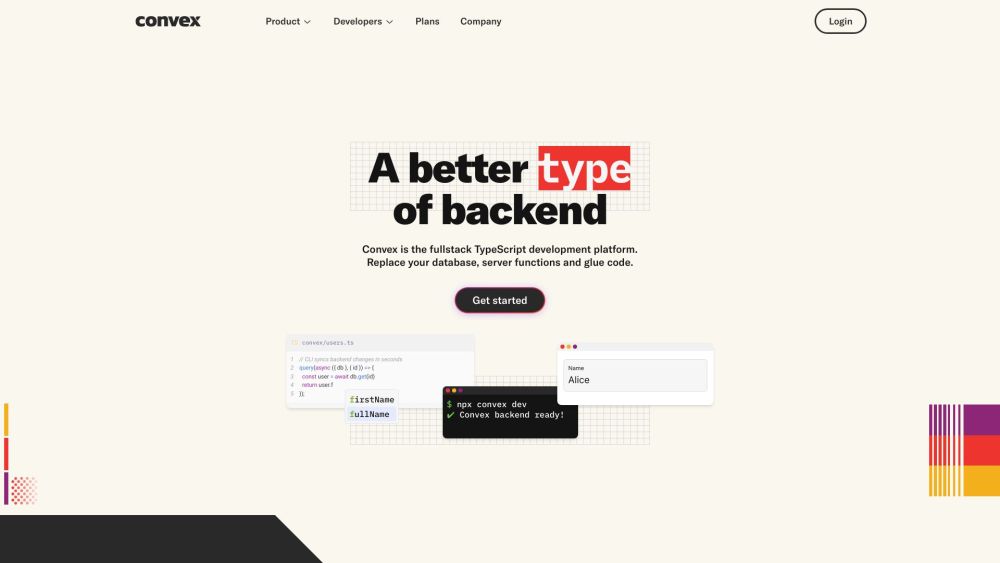

Découvrez la puissance d'une plateforme fullstack TypeScript spécifiquement conçue pour le développement d'applications hautement réactives. Grâce à ses capacités robustes, cette plateforme permet aux développeurs de créer des expériences utilisateur dynamiques et interactives sans effort, améliorant ainsi le développement tant front-end que back-end. Libérez le potentiel de la programmation réactive avec un framework TypeScript efficace et performant !

Find AI tools in YBX

Related Articles

Refresh Articles