Première arrestation enregistrée par le DOJ pour des contenus d'abus sexuels d'enfants générés par l'IA (CSAM)

Most people like

Déverrouillez le potentiel du conseil en GenAI aux côtés des produits d'IA d'entreprise à la pointe. Découvrez comment ces solutions innovantes peuvent transformer vos processus d'affaires, améliorer la prise de décision et favoriser la croissance dans le paysage compétitif actuel. Explorez les avantages d'intégrer l'expertise de GenAI avec des technologies d'IA avancées pour propulser votre entreprise vers de nouveaux sommets.

Dans le paysage numérique rapide d'aujourd'hui, une communication efficace est essentielle. L'outil de chat sans restrictions permet aux utilisateurs de vivre des interactions en temps réel sans limites. Que vous collaboriez avec une équipe, interagissiez avec des clients ou simplement vous connectiez avec des amis, cet outil améliore l'efficacité de la communication et renforce les relations. Découvrez comment un outil de chat sans restrictions peut transformer vos conversations et rapprocher les gens, en brisant les barrières d'un dialogue efficace.

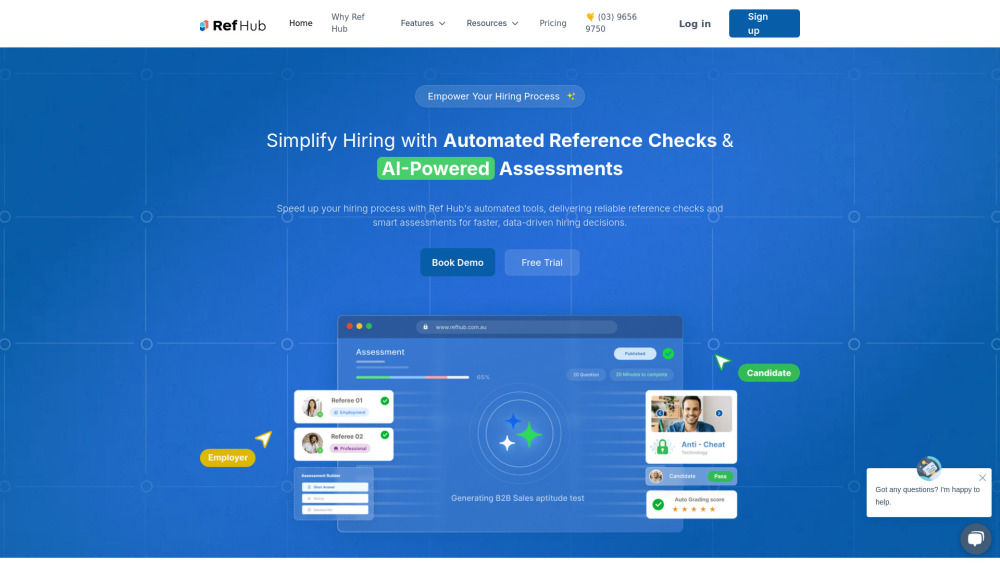

Découvrez la puissance des solutions de recrutement pilotées par l'IA qui simplifient votre processus de recrutement grâce à l'automatisation des vérifications de références et des évaluations de compétences. Améliorez votre efficacité de recrutement et assurez-vous de sélectionner les meilleurs candidats aisément.

Find AI tools in YBX