A Equipe de Superalinhamento da OpenAI Está Lutando Para Sobreviver Após Duas Saídas Significativas?

Most people like

Uma ferramenta de redação de ensaios avançada, movida por inteligência artificial, projetada para a criação de ensaios de forma fácil e com alta qualidade.

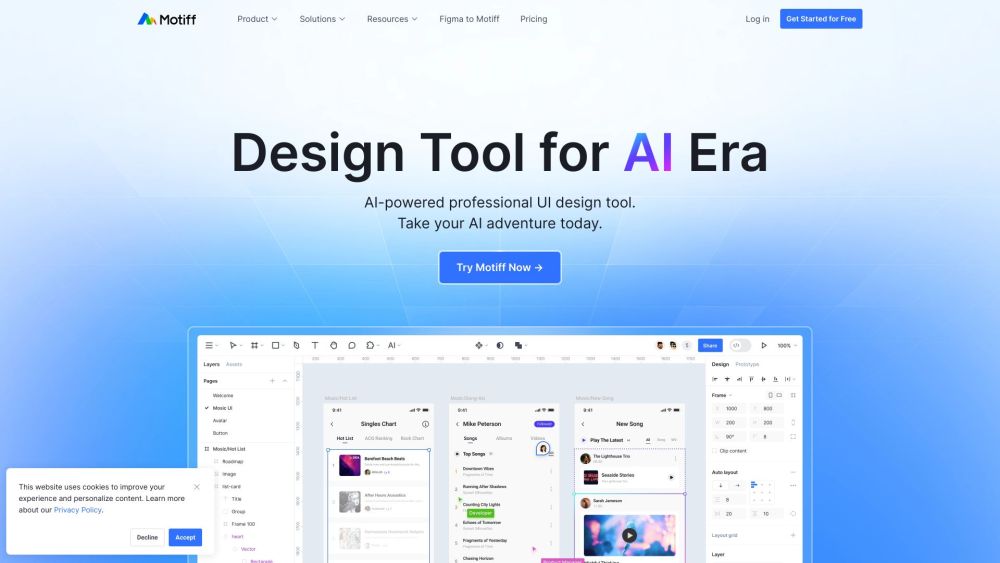

Desperte o potencial dos seus projetos criativos com nossa ferramenta de design impulsionada por IA, especialmente desenvolvida para prototipagem fluida e completa. Experimente uma abordagem inovadora que otimiza seu processo de design e eleva seus protótipos a um novo patamar.

Desperte o poder da redação de ensaios sem esforço com o EssayFlow. Crie ensaios únicos e com tom humano sem se preocupar com plágio. Experimente um processo de escrita fluido que eleva seu desempenho acadêmico hoje mesmo!

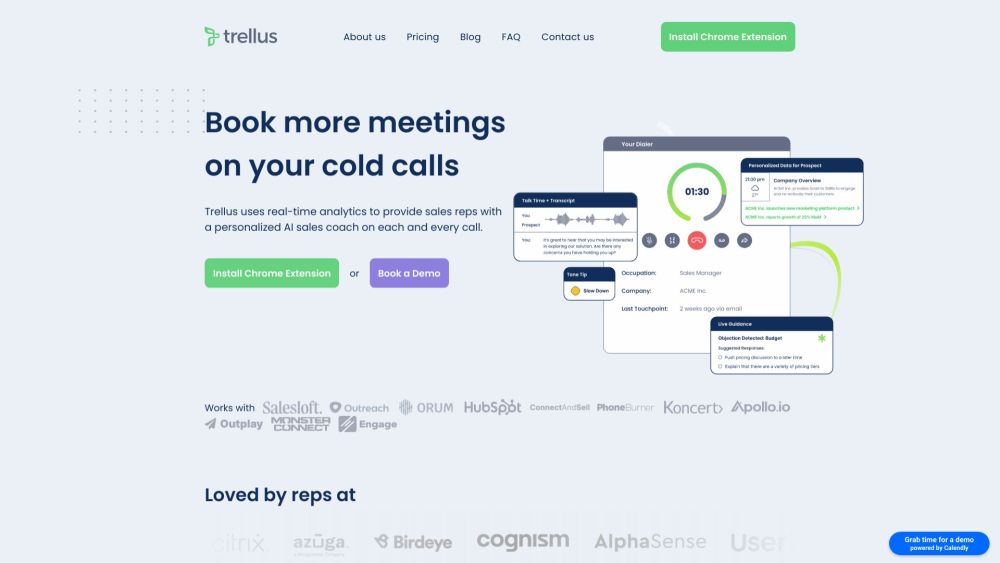

Apresentamos o Trellus, uma ferramenta inovadora impulsionada por IA, criada para oferecer coaching personalizado e análises em tempo real especificamente para representantes de vendas durante suas ligações frias. Com o Trellus, aprimore sua estratégia de ligações frias e impulsione o sucesso nas vendas por meio de insights e orientações sob medida.

Find AI tools in YBX

Related Articles

Refresh Articles