OpenAI untersucht Text-Wasserzeichen für ChatGPT, um Betrug unter Schülern zu erkennen.

Most people like

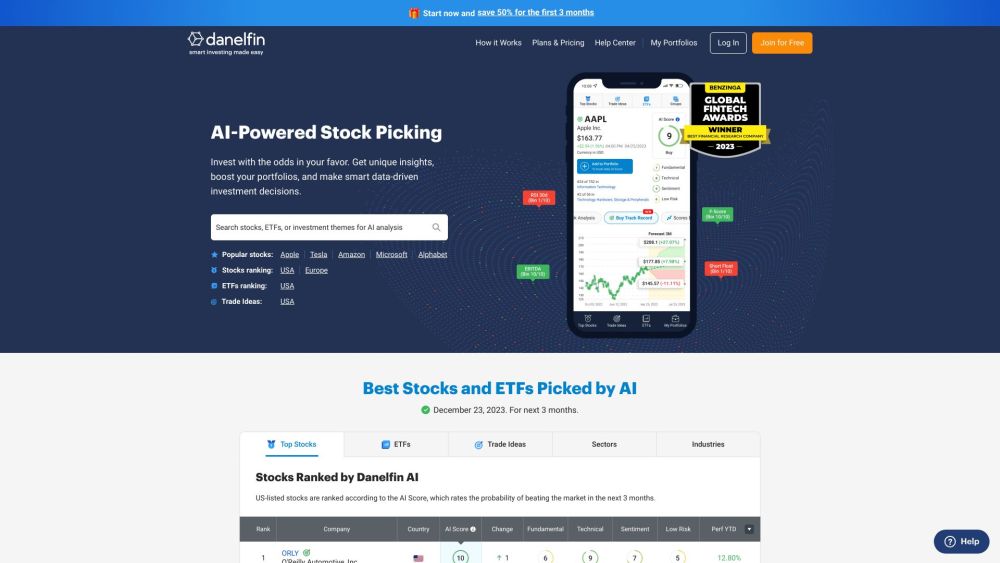

Entdecken Sie leistungsstarke Aktien und verbessern Sie Ihre Anlageportfolios mit KI-gestützten Erkenntnissen, die leicht verständlich sind.

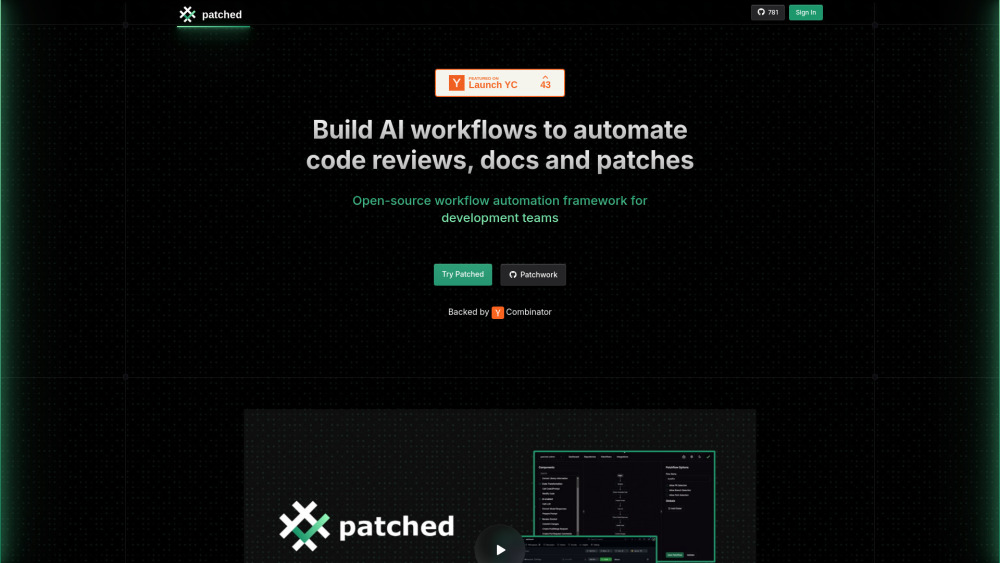

Steigern Sie die Effizienz Ihres Entwicklungsteams mit Open-Source-Automatisierungstools, die darauf ausgelegt sind, Arbeitsabläufe zu optimieren. Entdecken Sie, wie diese innovativen Lösungen Ihre Prozesse transformieren und die Produktivität für ein agileres Arbeitsumfeld steigern können.

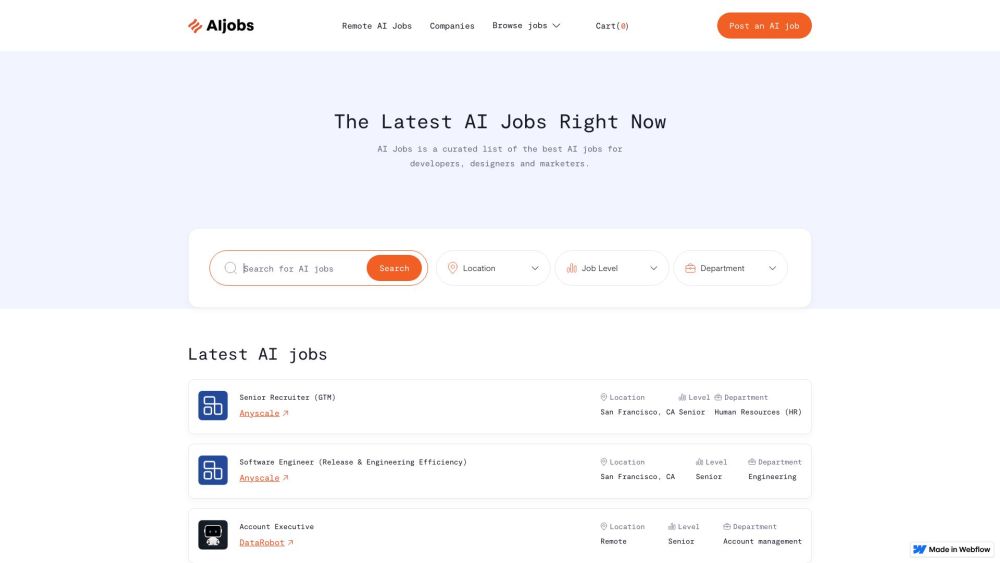

Entdecken Sie unsere sorgfältig ausgewählten AI-Jobangebote

Entdecken Sie eine handverlesene Auswahl der besten Karrieremöglichkeiten im Bereich Künstliche Intelligenz, die Ihnen dabei helfen, Ihre Karriere in diesem dynamischen Feld voranzutreiben. Egal, ob Sie ein erfahrener Profi oder neu im Bereich sind, unsere kuratierten Angebote erleichtern es Ihnen, spannende Positionen zu finden, die zu Ihren Fähigkeiten und Zielen passen. Begleiten Sie uns auf Ihrem Weg, Ihr Potenzial in der KI zu entfalten!

Find AI tools in YBX

Related Articles

Refresh Articles