Weißes Haus sichert sich freiwillige Zusagen von KI-Unternehmen im Kampf gegen Deepfake-Pornografie

Most people like

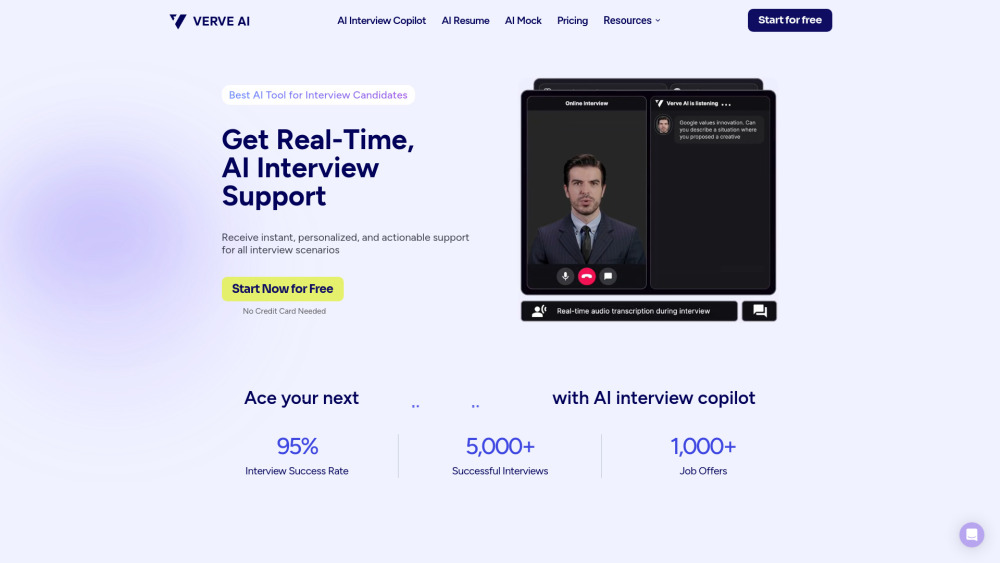

Präsentation des ultimativen Interview-Co-Piloten: die schnellste, präziseste und kosteneffektivste Lösung, speziell für Bewerber entwickelt.

Verbessern Sie Ihr Lernerlebnis mit QuizMate, dem KI-gestützten Tool, das Ihren Lernprozess optimiert.

Entdecken Sie die Kraft von KI-gesteuerten Online-Mediertools, die darauf ausgelegt sind, Ihre Video-, Audio- und Fotoinhalte zu optimieren. Diese innovativen Lösungen nutzen künstliche Intelligenz, um die Produktion zu optimieren, die Qualität zu verbessern und die Kreativität zu steigern, sodass es einfacher denn je ist, Ihr Publikum zu begeistern.

Entdecken Sie eine All-in-One-Marketingplattform, die darauf ausgelegt ist, Ihre Aufgaben zu automatisieren, Ihre Arbeitsabläufe zu optimieren und die Kundenbindung mühelos zu steigern. Ideale für Unternehmen, die Effizienz anstreben, vereinfacht diese umfassende Lösung Ihre Marketingaktivitäten und maximiert gleichzeitig Ihre Wirkung.

Find AI tools in YBX