“Compilador LLM de Meta: Una Solución de IA para Mejorar la Generación de Código y la Eficiencia de Compilación”

Most people like

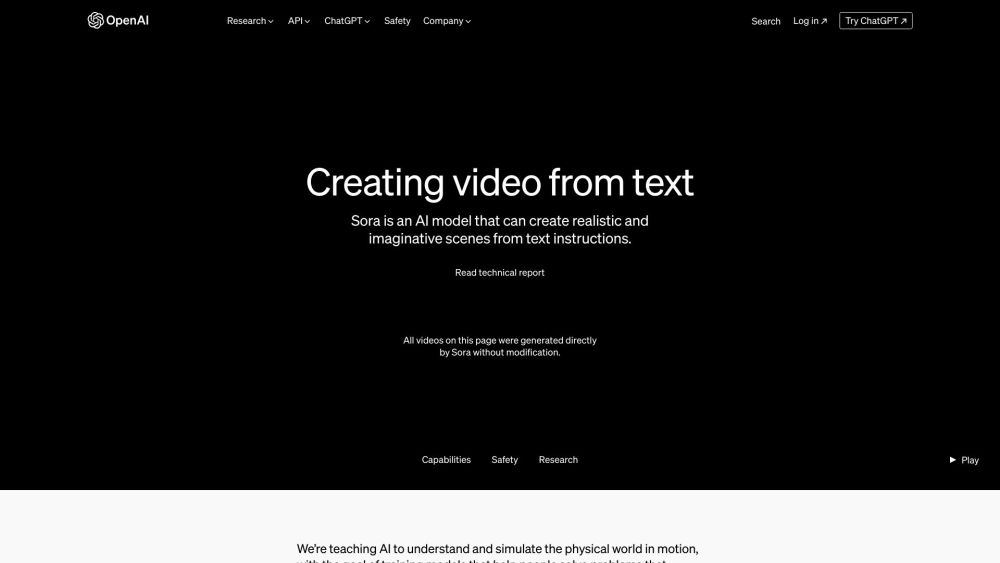

Presentamos un modelo de IA diseñado para transformar texto en escenas vívidas. Esta innovadora tecnología revoluciona la narración al dar vida a la imaginación a través de impresionantes visuales. Ya seas un escritor que explora nuevas avenidas creativas o un profesional del marketing que busca mejorar el compromiso, este modelo de IA ofrece una forma única de visualizar conceptos e ideas. Experimenta el futuro de la narración visual con potentes capacidades de IA que convierten palabras en imágenes cautivadoras.

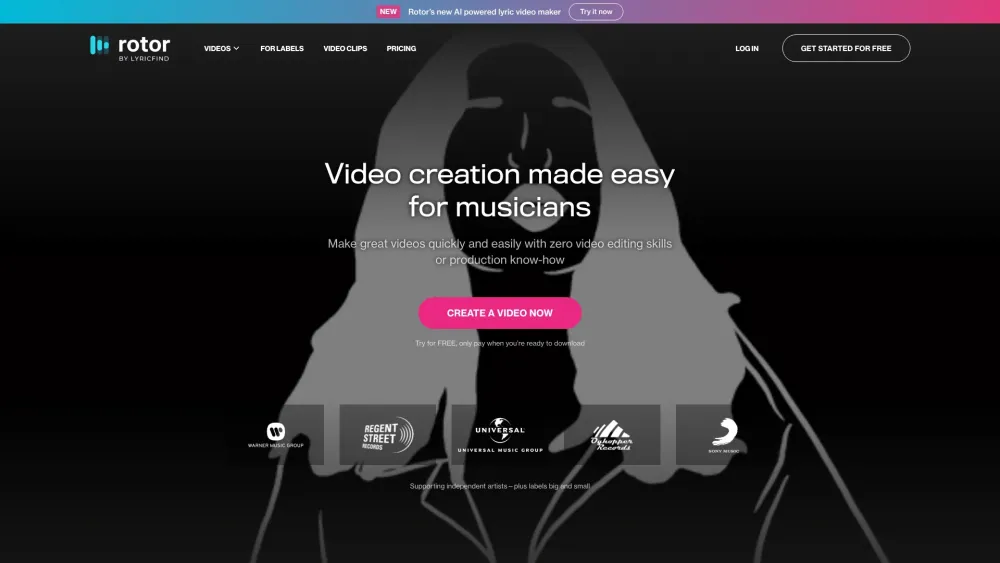

Crea fácilmente vídeos musicales cautivadores, atractivos vídeos con letras y mucho más en solo minutos.

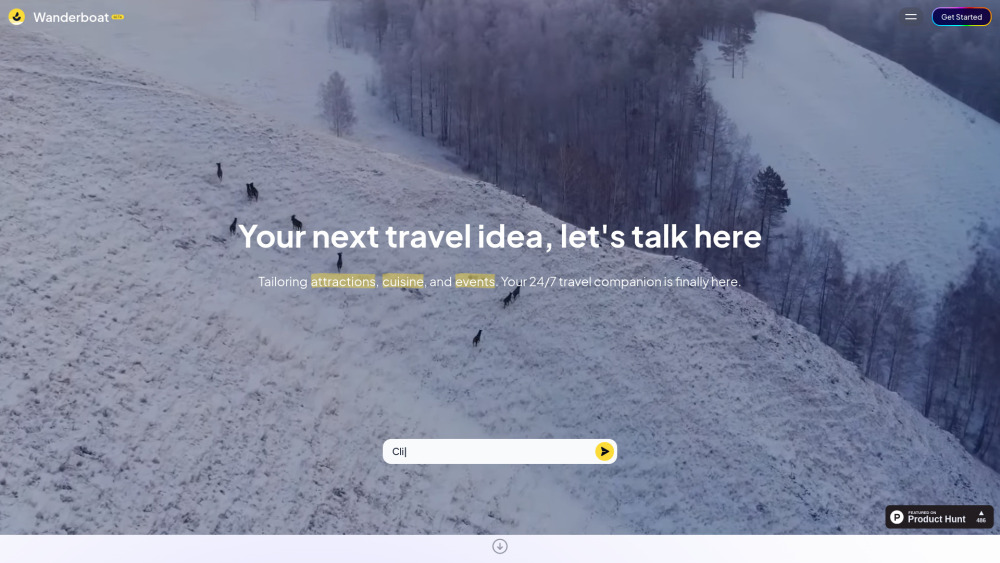

Descubre una nueva forma de explorar el mundo con nuestro planificador de viajes impulsado por IA, diseñado para crear experiencias personalizadas adaptadas a tus preferencias únicas. Ya sea que busques aventura, relajación o inmersión cultural, nuestra tecnología de vanguardia analiza tus intereses para elaborar un itinerario perfecto solo para ti. Convierte tus sueños de viaje en realidad y emprende aventuras inolvidables que resuenen con tu estilo personal.

Find AI tools in YBX

Related Articles

Refresh Articles