Google suspend la fonctionnalité de génération de profils de Gemini suite à de nombreuses inexactitudes "woke".

Most people like

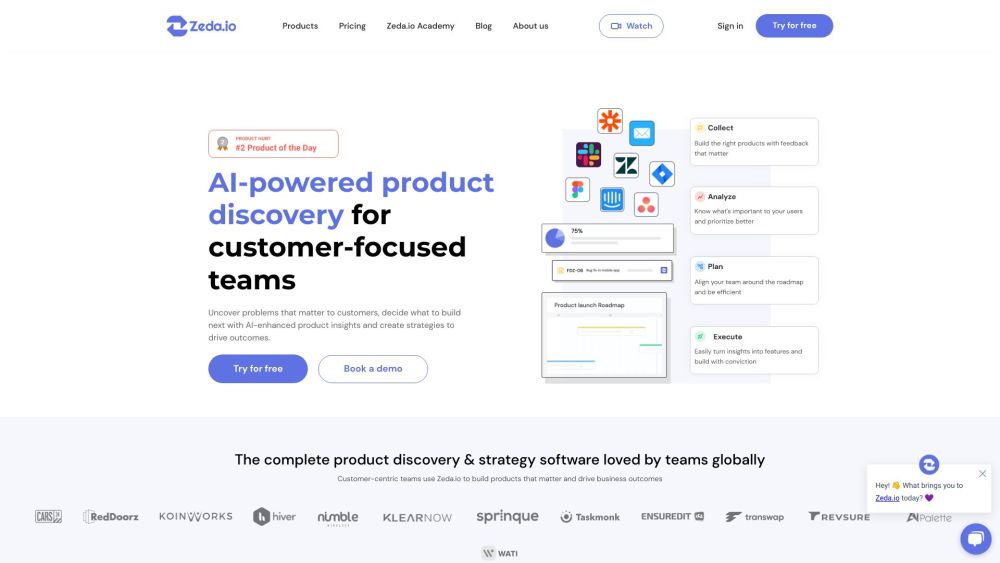

Découvrez la super application ultime pour les équipes produit ! Planifiez, construisez et itérez vos produits sans effort pour améliorer l'efficacité et assurer le succès. Optimisez votre flux de travail et collaborez facilement grâce à nos outils innovants spécialement conçus pour le développement de produits.

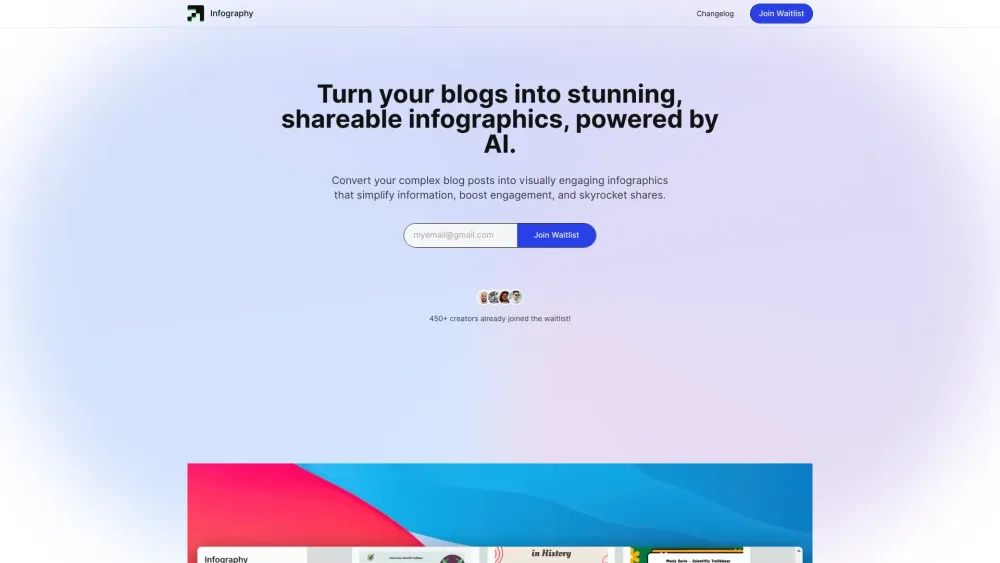

Cherchez-vous à améliorer le contenu de votre blog et à captiver votre audience ? Transformer vos articles en infographies accrocheuses est une méthode puissante pour présenter l'information de manière visuelle. Les infographies simplifient non seulement des données complexes, mais les rendent également plus partageables, augmentant ainsi la portée de votre contenu. Dans ce guide, nous explorerons des stratégies efficaces pour convertir votre contenu écrit en infographies époustouflantes qui engagent les lecteurs et rehaussent la visibilité de votre marque. Découvrez comment maximiser l'impact de vos articles de blog en exploitant l'art des infographies !

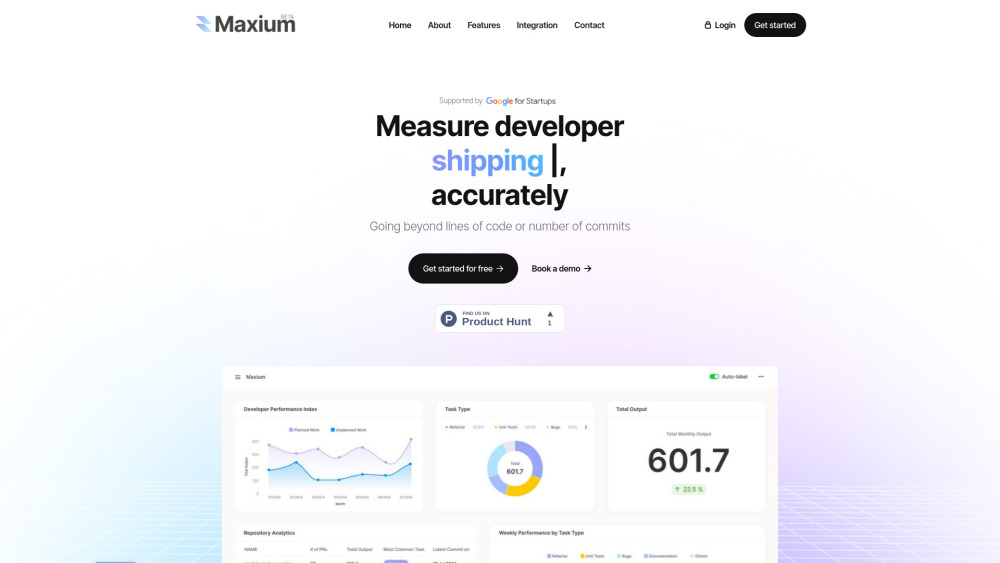

Fournit des informations instantanées sur la performance et l'efficacité des équipes d'ingénierie. Découvrez comment les données en temps réel peuvent améliorer la productivité et favoriser des résultats de projet réussis.

Découvrez une plateforme de productivité alimentée par l'IA, spécialement conçue pour les équipes, révolutionnant la manière dont vous collaborez et gérez vos projets. Cette solution innovante améliore l'efficacité, optimise les processus et favorise une communication fluide, permettant à votre équipe d'accomplir davantage ensemble. Découvrez comment notre plateforme transforme la productivité grâce à l'automatisation intelligente et à des analyses approfondies.

Find AI tools in YBX