OpenAI et Anthropic exhortent le gouvernement américain à privilégier l'évaluation des risques liés aux nouveaux modèles d'IA.

Most people like

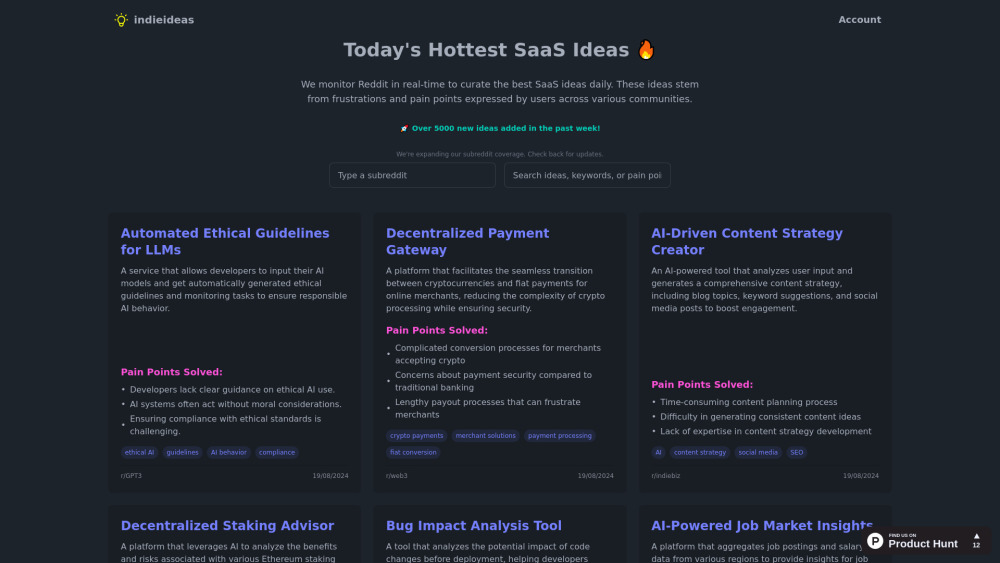

Découvrez des solutions SaaS innovantes inspirées des défis quotidiens des utilisateurs de Reddit.

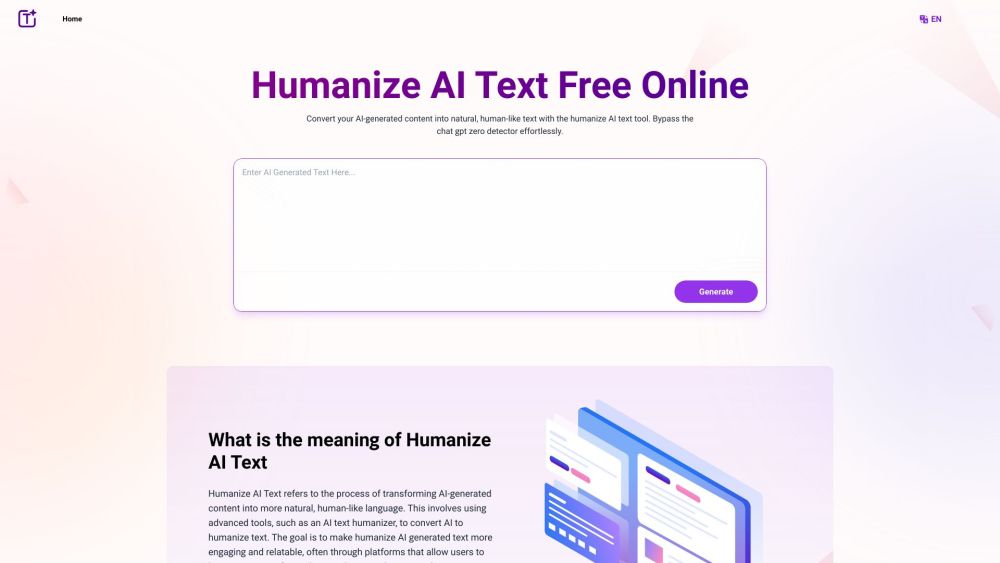

Dans le paysage numérique actuel, la capacité de transformer le contenu généré par l'intelligence artificielle en texte engageant et ressemblant à celui d'un humain est essentielle. Que vous soyez un marketer, un écrivain ou un entrepreneur, maîtriser cette compétence peut considérablement améliorer votre communication et votre connexion avec votre public. En tirant parti de la technologie avancée de l'IA, vous pouvez produire un contenu de haute qualité et pertinent qui résonne avec les lecteurs. Explorons les meilleures pratiques pour convertir les résultats de l'IA en texte captivant qui imite les subtilités de l'expression humaine tout en conservant l'information intrinsèque.

Find AI tools in YBX

Related Articles

Refresh Articles