Près de la moitié de l'équipe de sécurité de l'AGI d'OpenAI quitte l'entreprise en raison d'inquiétudes croissantes concernant les problèmes de sécurité de l'IA.

Most people like

Libérez le potentiel d'interaction avec des personnes du monde entier en surmontant les barrières linguistiques. Adoptez le pouvoir d'une communication efficace et élargissez votre portée à des publics divers, favorisant des connexions significatives à l'échelle mondiale.

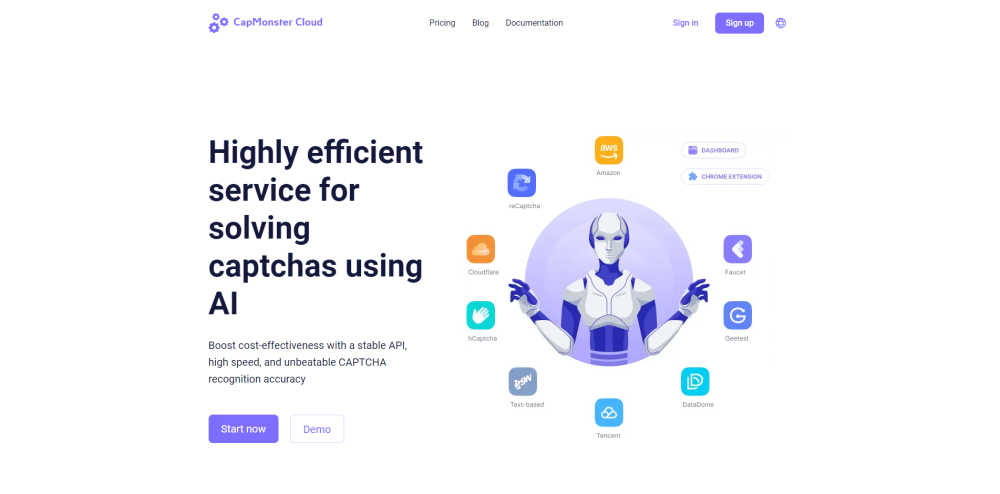

Présentation de CapMonster Cloud : un service avancé de résolution de CAPTCHA alimenté par l'intelligence artificielle, qui simplifie l'automatisation de la résolution d'un large éventail de CAPTCHAs, y compris reCAPTCHA, hCaptcha, et bien d'autres. Grâce à sa technologie innovante, CapMonster Cloud améliore l'efficacité et l'expérience utilisateur lors de la navigation sur les plateformes en ligne.

Débloquez votre créativité et apprenez à créer des bandes dessinées captivantes grâce à la technologie de l'IA. Découvrez les outils et techniques innovants qui rendent plus facile que jamais la réalisation de votre vision narrative, tout en exploitant la puissance de l'intelligence artificielle. Adoptez l'avenir de la bande dessinée et commencez votre parcours artistique dès aujourd'hui !

Présentation d'un synthétiseur vocal IA avancé qui prend en charge sans effort une variété d'accents et de services vocaux. Idéal pour améliorer le contenu audio et engager les utilisateurs à l'échelle mondiale, cet outil de pointe permet une communication fluide à travers différentes langues et dialectes. Élevez vos projets avec notre technologie vocale polyvalente, conçue pour la clarté et l'adaptabilité.

Find AI tools in YBX