Почти половина команды по безопасности AGI OpenAI покинула компанию на фоне растущих опасений по поводу проблем с безопасностью искусственного интеллекта.

Most people like

В современном цифровом мире компании всё чаще обращаются к умным индивидуальным чат-ботам для улучшения взаимодействия с клиентами и оптимизации операций. Используя передовые технологии ИИ, эти чат-боты могут предоставлять персонализированную поддержку, отвечать на запросы в реальном времени и значительно улучшать пользовательский опыт. Независимо от того, стремитесь ли вы увеличить продажи, улучшить обслуживание клиентов или автоматизировать рутинные задачи, инвестиции в разработку индивидуальных чат-ботов — это стратегический шаг для любой прогрессивной организации. Исследуйте трансформационный потенциал чат-ботов и их способность стимулировать рост и вовлеченность вашего бренда.

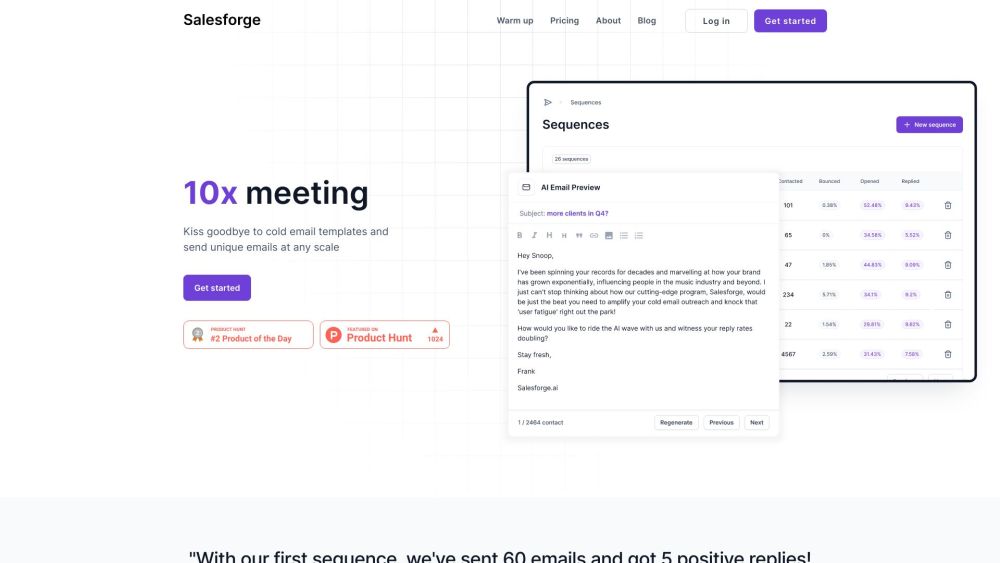

Откройте для себя мощь нашей платформы для email-рассылок, основанной на искусственном интеллекте, разработанной для создания уникальных и персонализированных писем, которые находят отклик у вашей аудитории. Улучшите свою стратегию коммуникации и увеличьте вовлеченность с помощью адаптированных сообщений, которые выделяются на фоне переполненных почтовых ящиков.

Представляем Jam: эффективный инструмент для отчетности об ошибках, разработанный для упрощения процесса сбора информации об ошибках для пользователей. Благодаря удобному интерфейсу, Jam позволяет командам легче и быстрее выявлять, отслеживать и решать проблемы.

Представляем вам комплект для музыкального производства с ИИ, инновационный инструмент, разработанный для революции в создании музыки. Это современное программное обеспечение использует возможности искусственного интеллекта для повышения вашей креативности и оптимизации рабочего процесса. Независимо от того, являетесь ли вы опытным музыкантом или начинающим артистом, наш комплект предлагает ряд функций, которые упрощают и ускоряют музыкальное производство. Узнайте, как эта трансформирующая технология может поднять ваше звучание и вдохновить на следующий музыкальный проект.

Find AI tools in YBX