اضطرابات OpenAI: تحديات القيادة، مخاوف الثقة، والفرص الناشئة لـ Google و Anthropic — 4 نقاط أساسية تحتاج إلى معرفتها

Most people like

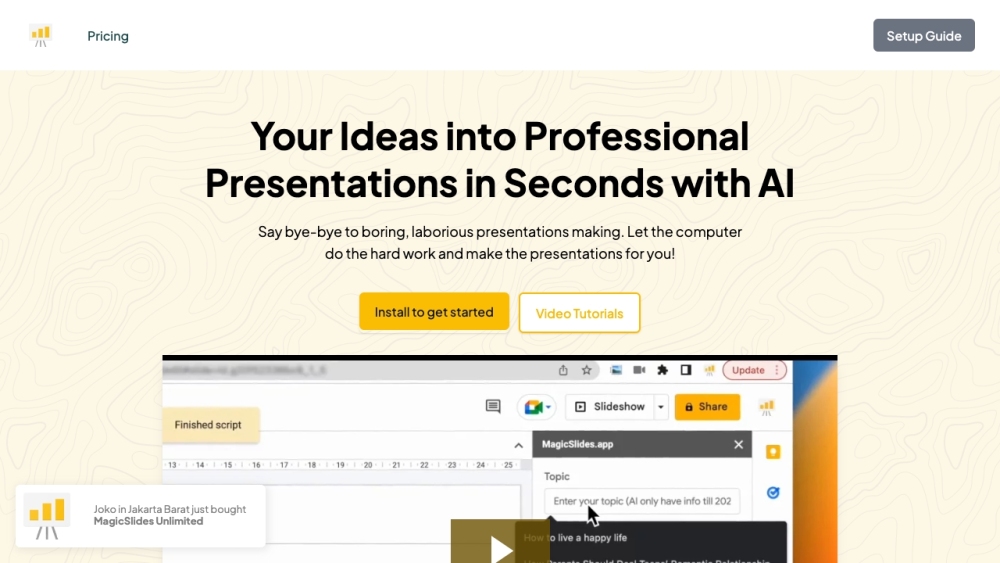

تستخدم MagicSlides قوة الذكاء الاصطناعي لإنشاء شرائح تقديمية مذهلة من أي نص. حول أفكارك إلى عروض تقديمية بصرية ساحرة بكل سهولة!

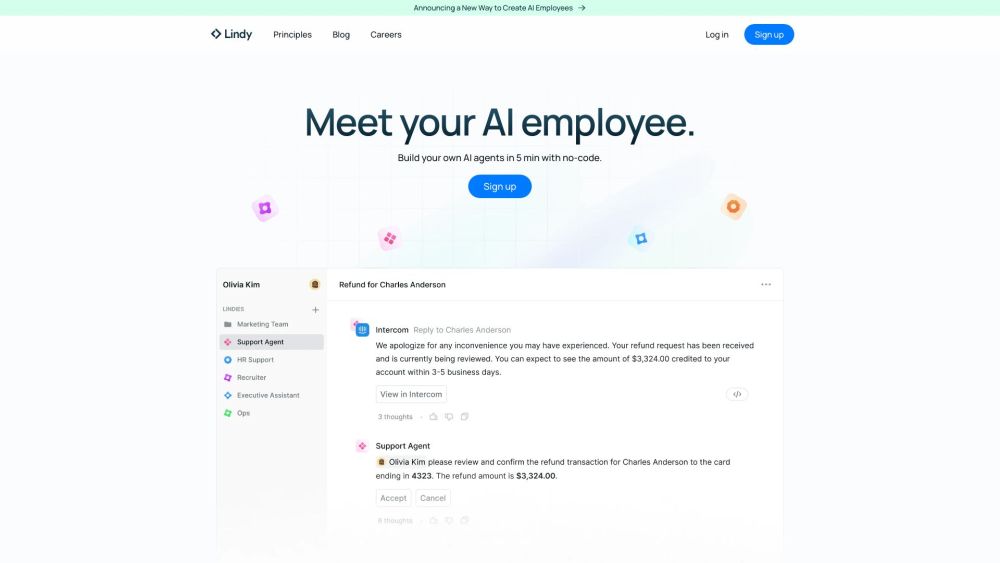

أنشئ وكلاء ذكاء اصطناعي خاصين بك بسهولة—لا حاجة لأي برمجة!

اكتشف قوة الذكاء الاصطناعي من خلال بناء وكلاء ذكيين مخصصين دون الحاجة إلى معرفة البرمجة. سواء كنت صاحب عمل، مطوراً، أو مجرد شخص فضولياً بشأن الذكاء الاصطناعي، توفر لك منصتنا إمكانية تصميم ونشر وكلاء ذكيين مصممين حسب احتياجاتك الخاصة. اغمر في عالم الحلول بدون برمجة واجعل أفكارك المتعلقة بالذكاء الاصطناعي تتحقق بسهولة!

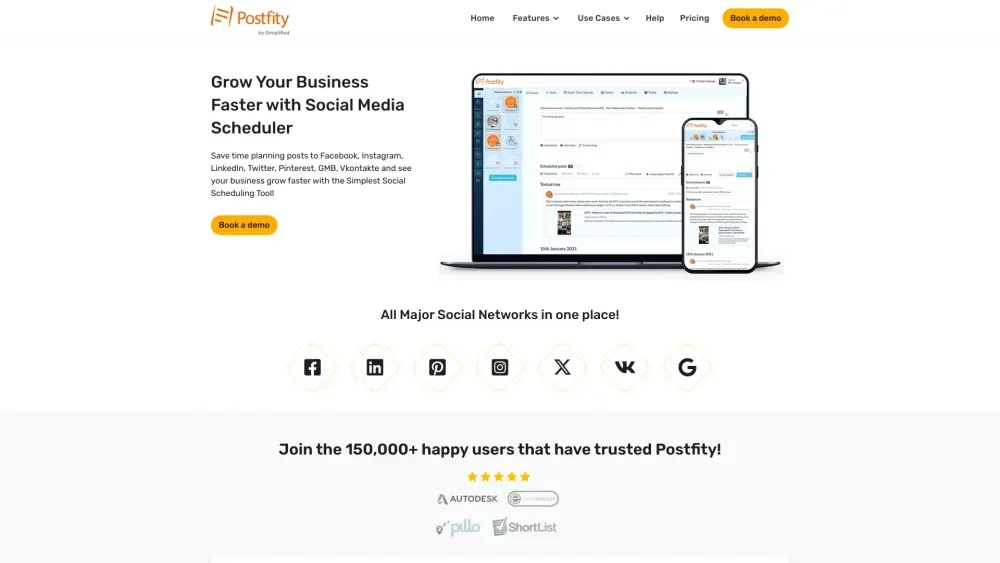

حوّل استراتيجيتك على وسائل التواصل الاجتماعي مع جدول زمني فعال مصمم لمتعدد المنصات. ادارة، تخطيط، وأتمتة منشوراتك بسهولة لتعزيز التفاعل والوصول إلى جمهورك عبر قنوات مختلفة. وفِّر الوقت وزيِّد من وجودك الرقمي من خلال استخدام أداة قوية تنظِّم جدولة محتواك وتُحسِّن تأثيرك على وسائل التواصل الاجتماعي.

Find AI tools in YBX