Google DeepMind kehrt mit dem neuen Modell Gemma in den Open-Source-AI-Wettbewerb zurück.

Most people like

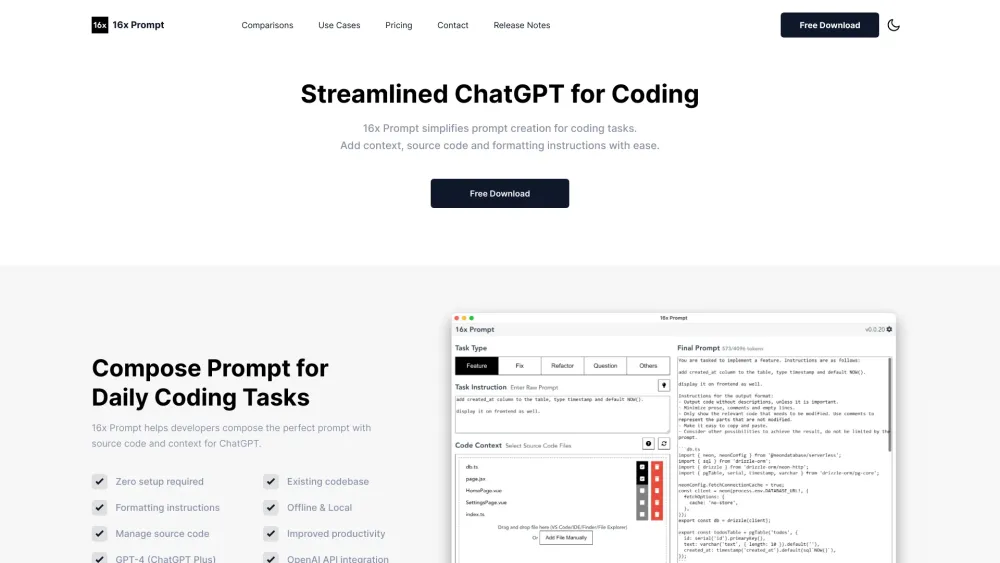

Präsentation einer optimierten Plattform, die speziell für Programmieraufforderungen entwickelt wurde. Dieses benutzerfreundliche Tool verbessert Ihr Programmiererlebnis, indem es einen organisierten Raum bietet, um Aufforderungen zu erkunden, zu erstellen und zu teilen. So wird es einfacher denn je, Inspiration zu finden und Ihre Programmierfähigkeiten zu verbessern. Werden Sie Teil unserer Gemeinschaft und entfalten Sie Ihr Codierungspotential noch heute!

Outerbase ist eine innovative Plattform, die für die kollaborative Datenexploration und -visualisierung entwickelt wurde, ähnlich wie Figma. Diese benutzerfreundliche Oberfläche ermöglicht es Teams, Daten gemeinsam zu analysieren und zu präsentieren, wodurch die Produktivität und die Einsichten verbessert werden.

KI-Inhalte und Chat-Plattformen revolutionieren die Interaktion von Unternehmen mit ihren Kunden. Durch den Einsatz fortschrittlicher Künstlicher Intelligenz ermöglichen diese Plattformen eine nahtlose Kommunikation, steigern das Nutzerengagement und optimieren die Inhaltserstellung. Da Organisationen zunehmend auf digitale Lösungen setzen, um Kundenerlebnisse zu verbessern und die Effizienz zu steigern, ist das Verständnis der Möglichkeiten und Vorteile von KI-gestützten Werkzeugen unerlässlich geworden. Entdecken Sie, wie diese innovativen Technologien nicht nur den Kundenservice transformieren, sondern auch die Bereitstellung von Inhalten im digitalen Raum neu gestalten.

Find AI tools in YBX

Related Articles

Refresh Articles