NVIDIA präsentiert neues 8B AI-Modell: Höchste Präzision und Effizienz, kompatibel mit RTX-Workstations

Most people like

Entfalten Sie Ihr Potenzial mit einer KI-Plattform für mühelose Prüfungs- und Hausaufgabenlösungen durch Fotos.

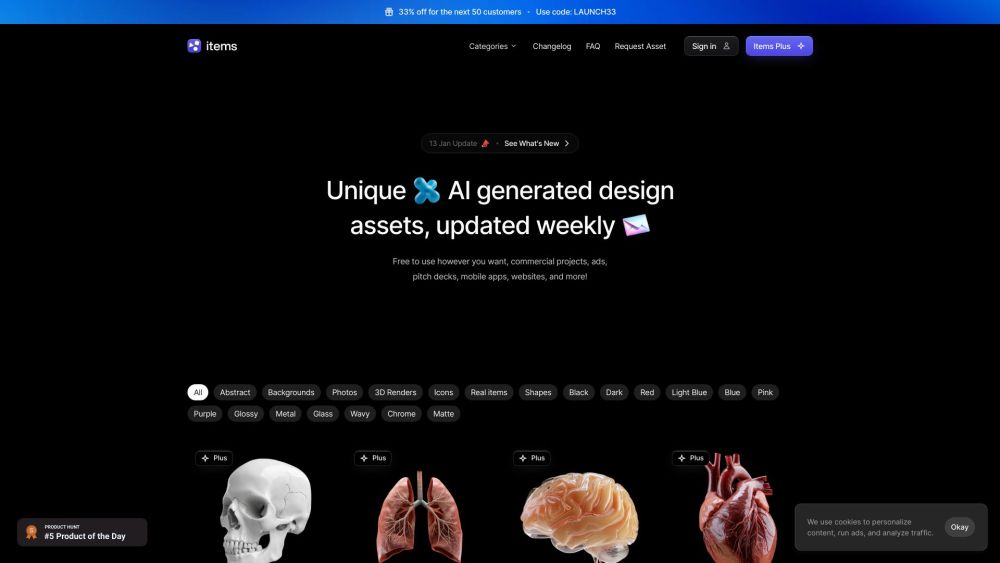

Entdecken Sie einen Schatz an kostenlosen, KI-generierten Designelementen, die ideal sind, um Ihre Websites, Apps und Präsentationen aufzuwerten. Durchstöbern Sie eine vielfältige Sammlung, die Ihre Projekte mit beeindruckenden visuellen Inhalten und intuitiven Designs veredelt – alles kostenlos!

Find AI tools in YBX

Related Articles

Refresh Articles