Stable Diffusion 3.5: Verbesserte Prompt-Antwort und erhöhte Vielfalt bei der Character-Generierung

Most people like

Optimieren Sie Ihren externen Rekrutierungsprozess, indem Sie personalisierte Nachrichten in großem Maßstab versenden.

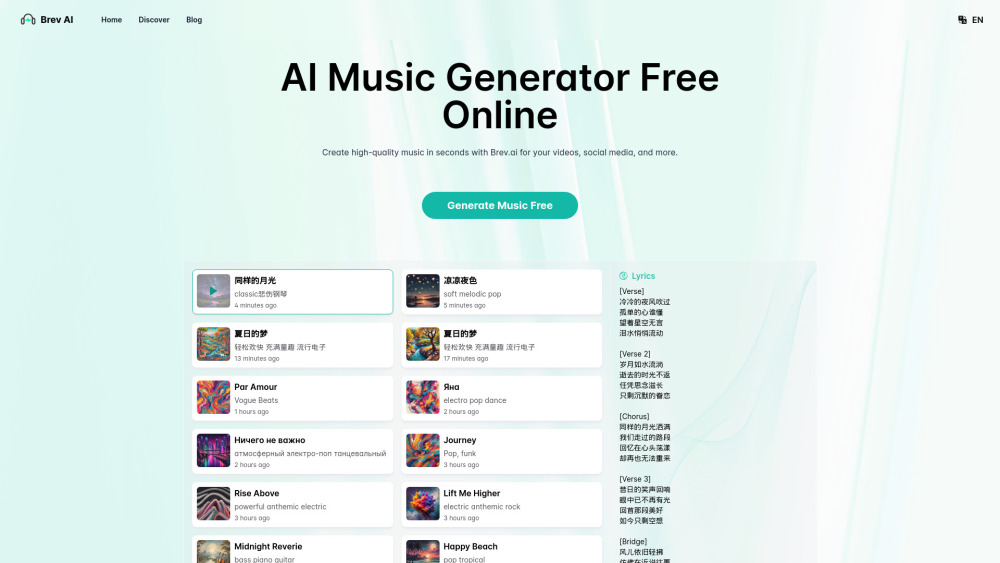

Verwandeln Sie Ihre kreativen Ideen sofort in hochwertige Musik mit unserem fortschrittlichen KI-Musikgenerator, der online kostenlos verfügbar ist.

In der heutigen schnelllebigen digitalen Landschaft haben personalisierte Unterhaltungsplattformen die Art und Weise revolutioniert, wie wir Inhalte konsumieren. Diese maßgeschneiderten Dienste gestalten Erlebnisse basierend auf Ihren Vorlieben und gewährleisten, dass jeder Nutzer eine individuell angepasste Sehreise genießen kann. Mit fortschrittlichen Algorithmen und einer breiten Palette von Optionen sparen diese Plattformen nicht nur Zeit, sondern verbessern auch Ihr gesamtes Unterhaltungserlebnis, indem sie Sie mit Serien und Filmen verbinden, die Sie lieben werden. Begleiten Sie uns, während wir die Vorteile und Merkmale dieser innovativen Unterhaltungslösungen erkunden.

Entdecken Sie die Kraft von KI-generierten, personalisierten Videos, die auf die einzigartigen Vorlieben und Bedürfnisse jedes Kunden abgestimmt sind. Verbessern Sie Ihre Marketingstrategie, indem Sie Ihr Publikum mit maßgeschneiderten Inhalten ansprechen, die Resonanz erzeugen und fesseln, und gewährleisten Sie so ein unvergessliches Erlebnis für jeden Zuschauer. Nutzen Sie das Potenzial individueller Videolösungen, um die Kundenzufriedenheit zu steigern und Konversionen zu fördern.

Find AI tools in YBX

Related Articles

Refresh Articles