¿Es posible obtener un Chevy por $1? Explorando los chatbots de IA y sus riesgos en el servicio al cliente automotriz.

Most people like

En el mundo digital acelerado de hoy, contar con un sistema de reservas en línea eficiente basado en aplicaciones es esencial para las empresas que buscan mejorar la comodidad del cliente y optimizar las operaciones. Esta solución innovadora permite a los usuarios programar citas, reservar servicios y gestionar reservas con facilidad, todo desde la palma de su mano. Al integrar un sistema de reservas en línea basado en aplicaciones en tu negocio, puedes mejorar significativamente la satisfacción del cliente y la eficiencia operativa, manteniéndote competitivo en tu industria. Explora los beneficios y características de esta tecnología transformadora para elevar tu proceso de reservas y aumentar tu clientela.

Descubre el poder del software de mapas mentales basado en IA, diseñado para ayudarte a visualizar tus pensamientos e ideas de manera efectiva. Esta herramienta innovadora potencia la creatividad, aumenta la productividad y agiliza tu proceso de lluvia de ideas, facilitando la organización y desarrollo de tus conceptos. Explora el impacto transformador de la IA en los mapas mentales y desbloquea tu potencial hoy mismo.

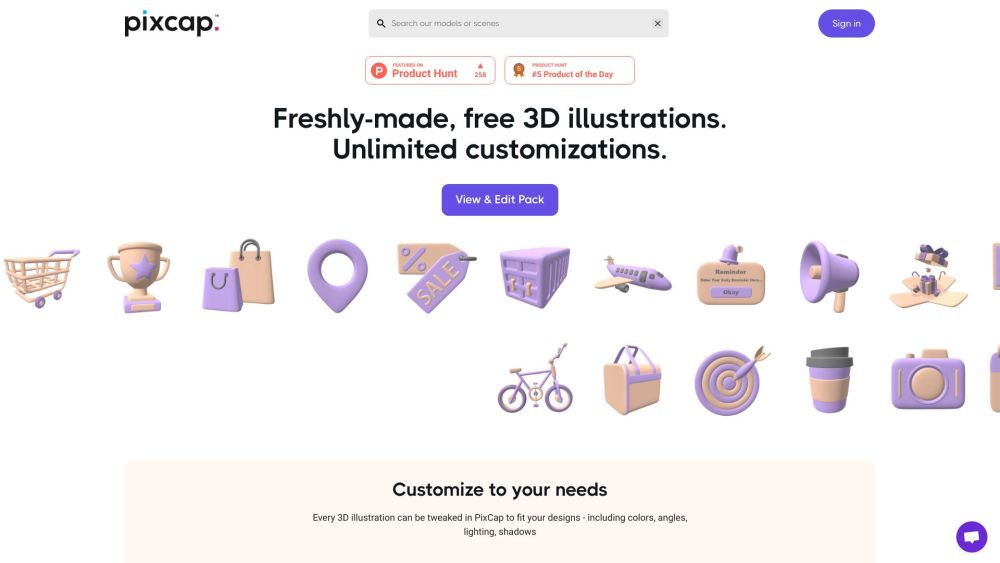

Pixcap es una herramienta de diseño gráfico de vanguardia que aprovecha el poder de la tecnología 3D y la inteligencia artificial para crear posibilidades de diseño ilimitadas.

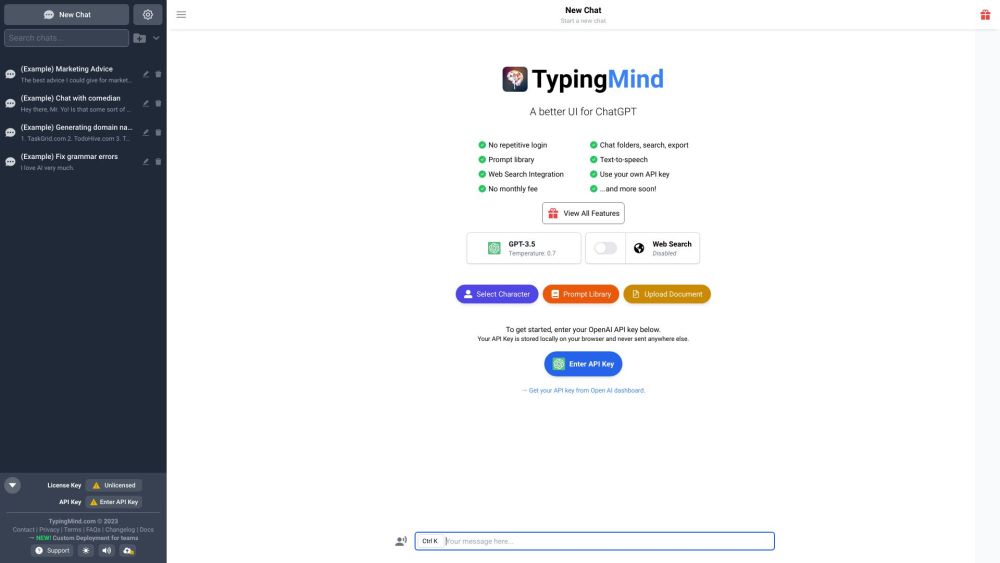

TypingMind mejora la experiencia de usuario de ChatGPT al introducir características valiosas como la búsqueda en el historial de chat y una biblioteca completa de prompts. Esta transformación innovadora de la interfaz no solo agiliza las interacciones, sino que también aumenta la productividad de los usuarios que buscan formas eficientes de interactuar con la IA.

Find AI tools in YBX

Related Articles

Refresh Articles