OpenAI, 2024년 글로벌 선거를 앞두고 AI 인용 및 이미지 안전 조치를 공개하다.

Most people like

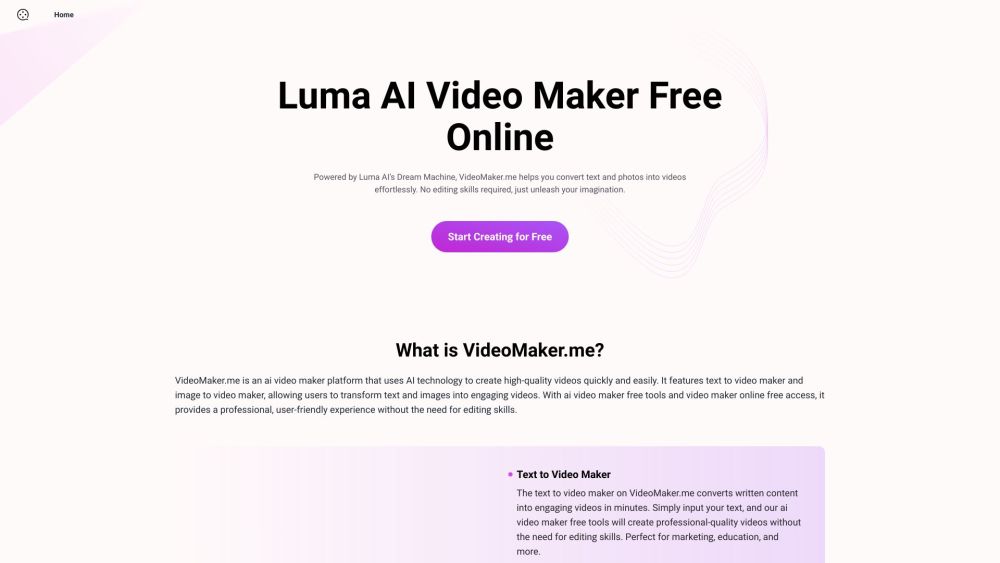

오늘날의 디지털 환경에서는 주목받는 것이 그 어느 때보다 중요합니다. 텍스트와 사진을 위한 AI 비디오 생성기를 사용하면 작성된 내용과 이미지를 매력적인 비디오로 쉽게 변환할 수 있습니다. 이 혁신적인 도구는 창작 과정을 간소화하여 청중을 사로잡는 멋진 시각적 내러티브를 만들어냅니다. 콘텐츠 제작자이든 마케팅 전문가이든 사업자이든, AI 비디오 생성기를 활용하면 스토리텔링을 강화하고 온라인 존재감을 높일 수 있습니다. 텍스트와 사진을 활용해 시청자와 공감할 수 있는 매력적인 비디오로 전환하여 참여를 증대시키는 방법을 알아보세요.

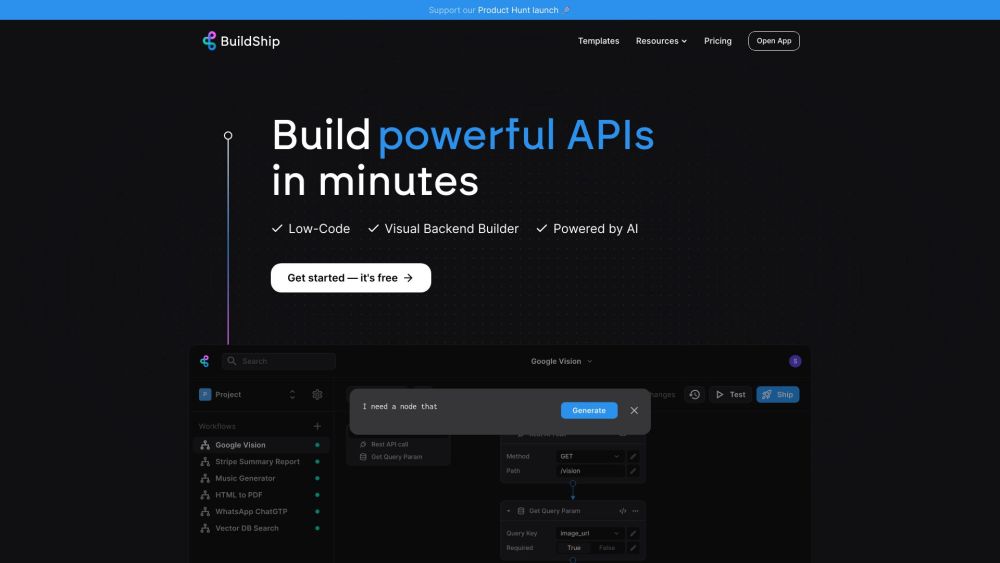

원활한 API 생성, 효율적인 예약 작업, 그리고 간소화된 백엔드 작업을 지원하는 비주얼 로우코드 플랫폼을 만나보세요. 복잡한 워크플로우를 간단하게 만들어주는 직관적인 도구로 개발 프로세스의 잠재력을 열어보세요.

Find AI tools in YBX

Related Articles

Refresh Articles