O recente anúncio da OpenAI finalmente esclareceu a incerteza que cercava a empresa nos últimos cinco dias: Sam Altman foi reintegrado como CEO, e três membros iniciais do conselho foram nomeados, com outros por vir.

No entanto, detalhes emergentes sobre os eventos que levaram a essa reviravolta revelam a necessidade de a OpenAI abordar questões de confiança que Altman pode enfrentar devido a suas ações recentes. Além disso, ainda falta clareza sobre como a empresa pretende resolver os desafios de governança em andamento, incluindo sua estrutura e responsabilidades do conselho, que têm sido percebidas como confusas e contraditórias.

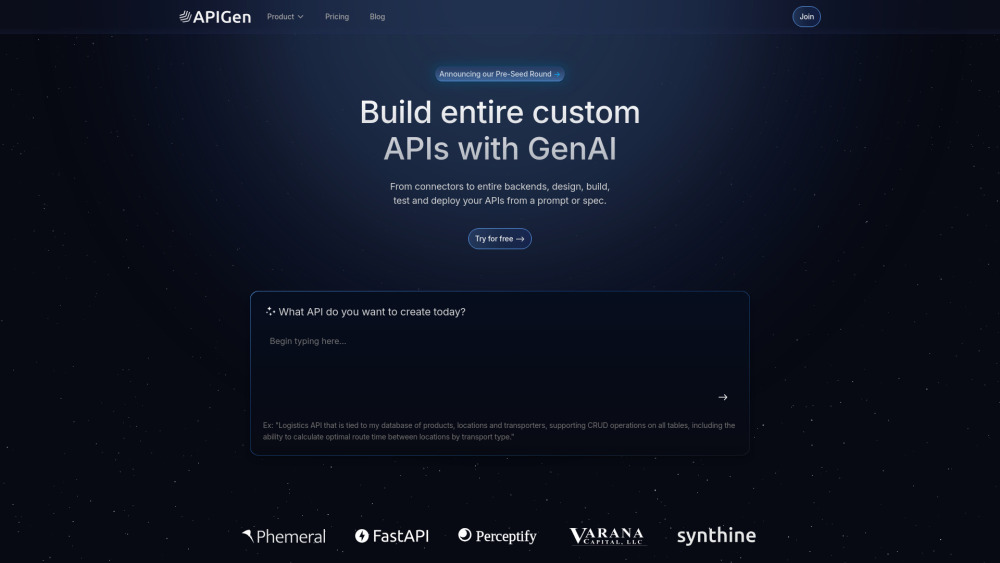

Para os tomadores de decisão nas empresas que acompanham essa saga, entender o que ocorreu é fundamental para avaliar a credibilidade da OpenAI no futuro. Esta situação marca uma potencial mudança em direção a uma abordagem mais agressiva e orientada para produtos. Embora os modelos de linguagem da OpenAI, como o ChatGPT e o GPT-4, devam continuar populares entre os desenvolvedores como APIs em diversas aplicações, a reputação da empresa como fornecedora confiável de soluções abrangentes de IA para empresas pode diminuir.

Um fator significativo que impactou a confiança dentro da empresa surgiu das críticas de Altman ao trabalho da conselheira Helen Toner sobre segurança em IA. Em outubro, Altman contestou um artigo escrito por Toner que discutia os processos de tomada de decisão da OpenAI em comparação com seu concorrente, a Anthropic. Enquanto a OpenAI optou por lançar seu modelo de linguagem, a Anthropic adiou seu lançamento devido a preocupações de segurança. Segundo o estudo, essa decisão estratégica da Anthropic representou um compromisso com a segurança da IA, contrastando com a abordagem mais rápida da OpenAI.

Após as reclamações de Altman sobre o artigo de Toner, ele comunicou aos colegas que essa crítica era necessária para a segurança da empresa, especialmente devido às investigações em andamento da FTC sobre o uso de dados pela OpenAI. Toner, em resposta, enfatizou a natureza acadêmica de seu trabalho, levando a discussões entre os altos líderes da OpenAI sobre sua possível remoção do conselho. No final, o cofundador Ilya Sutskever, preocupado com os riscos da IA, apoiou a destituição de Altman por não ser "consistentemente transparente" com o conselho.

A tensão entre Altman e Toner destacou questões de alinhamento com o objetivo fundamental da empresa de desenvolver uma inteligência geral artificial (AGI) segura para o benefício da humanidade, em vez de investidores.

Na decisão de reintegrar Altman, na noite passada, Toner e a conselheira Tasha McCauley escolheram renunciar em busca de um novo começo, apesar de acreditarem que suas ações eram justificadas. O conselho manteve Adam D’Angelo, outro membro que apoiou a remoção de Altman, para facilitar negociações com o CEO interino Emmett Shear e os novos membros do conselho. O novo conselho, que conta com Bret Taylor e Lawrence Summers, possui fortes credenciais e experiência, prometendo direcionar a empresa para uma missão voltada ao crescimento.

Essa transição de liderança levanta questões sobre o futuro da OpenAI. A composição do conselho sugere uma transformação em uma empresa de produtos robusta, capaz de resolver questões de governança anteriores. No entanto, a saída dos membros que defendiam o altruísmo eficaz indica uma mudança crítica necessária para a viabilidade da OpenAI. Jaan Tallinn, um defensor vocal do altruísmo eficaz, destacou os riscos de confiar em uma governança altruísta no contexto das crises da OpenAI.

À medida que a empresa avança, estabelecer um conselho de diretores confiável e diverso será essencial para manter sua trajetória rumo ao sucesso. O comprometimento com a equidade e considerações éticas no desenvolvimento de IA é crucial.

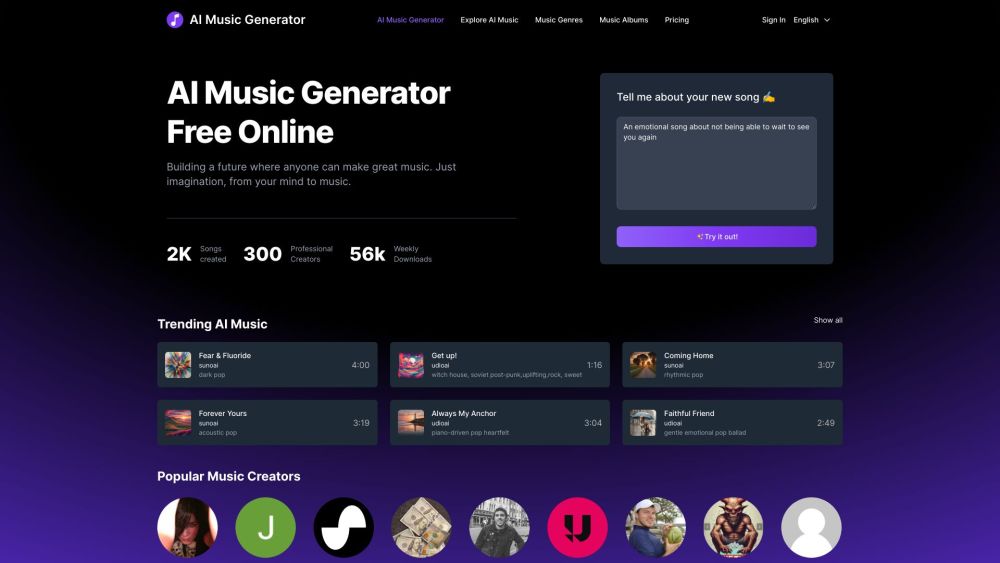

Em resumo, enquanto a OpenAI navega por esta fase, parece estar preparada para um futuro mais consolidado, voltado para o lucro e orientado a produtos. O objetivo é atender centenas de milhões com modelos de linguagem de propósito geral que atendem a diversas tarefas. No entanto, ainda não está claro se a OpenAI conseguirá alcançar a confiança e a governança necessárias para lidar com aplicações precisas, seguras e imparciais que as empresas requerem. Outros players podem precisar preencher essa lacuna.