OpenAI e Anthropic Firmam Acordo: Governo dos EUA Realizará Avaliações de Segurança Antecipadas em Novos Modelos de IA

Most people like

Apresentando uma Ferramenta de Roteiro de IA para YouTube: Revolucione Seu Processo de Criação de Conteúdo!

Você está buscando aprimorar seus vídeos do YouTube com roteiros envolventes? Nossa ferramenta de roteiro de IA é projetada especificamente para criadores como você. Com algoritmos avançados e capacidades de processamento de linguagem, ela ajuda a gerar conteúdo interessante de forma rápida e sem esforço. Diga adeus ao bloqueio criativo e olá à liberdade artística! Seja fazendo tutoriais, vlogs ou conteúdo educacional, nossa ferramenta garante que seus roteiros sejam cativantes e adequados ao seu público. Eleve sua produção de vídeo e cative seus espectadores como nunca antes!

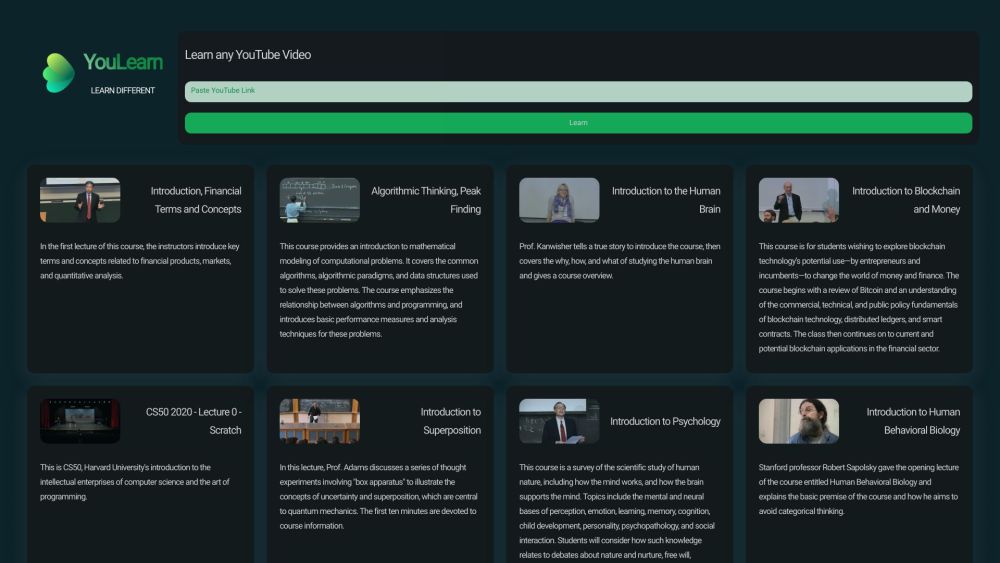

YouLearn é uma plataforma inovadora de tutoria com IA, projetada para personalizar sua experiência de aprendizado, oferecendo resumos e recursos de estudo sob medida. Descubra como nossa tecnologia adapta a educação para atender às suas necessidades únicas e impulsionar seu sucesso acadêmico.

Transforme sua experiência de estudo com nosso avançado criador de flashcards, equipado com ferramentas de estudo baseadas em IA de ponta. Crie, personalize e otimize suas sessões de estudo facilmente, aproveitando algoritmos inteligentes para melhorar a retenção e a compreensão. Adote uma forma mais inteligente de aprender e dominar novos conteúdos com nossa plataforma inovadora.

Find AI tools in YBX

Related Articles

Refresh Articles