أوبن إيه آي تعارض مشروع قانون سلامة الذكاء الاصطناعي في كاليفورنيا، معبّرة عن مخاوفها بشأن قيود الابتكار والتنمية.

Most people like

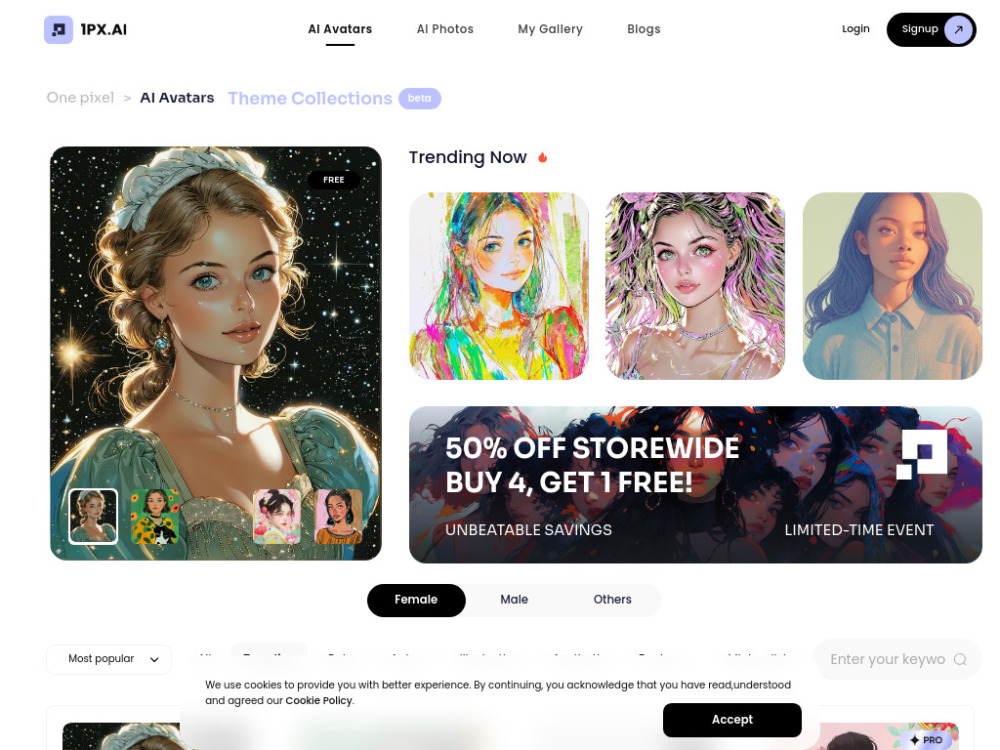

في السنوات الأخيرة، أحدثت مولدات الصور الشخصية بالذكاء الاصطناعي ثورة في طريقة إنشاء وتجربة الصور الفنية. من خلال استغلال الخوارزميات المتقدمة وتقنيات التعلم الآلي، يمكن لهذه الأدوات المبتكرة إنتاج صور رقمية رائعة في غضون ثوانٍ. سواء كنت فنانًا تبحث عن إلهام أو مجرد مهتم بقدرات الذكاء الاصطناعي، فإن فهم كيفية عمل هذه المولدات يمكن أن يفتح أمامك آفاقًا جديدة للإبداع والتعبير. ستتناول هذه الدليل العالم الرائع لمولدات الصور الشخصية بالذكاء الاصطناعي، مستكشفة تقنياتها وتطبيقاتها ومستقبل الفن الرقمي.

سنا هي منصة تعليمية مبتكرة مدعومة بالذكاء الاصطناعي، مصممة لمساعدة المؤسسات على اكتشاف ومشاركة المعرفة بسلاسة. من خلال خوارزمياتها المتقدمة، تعزز سنا تجارب التعلم، مما يسهل على الفرق الوصول إلى معلومات ومهارات قيمة.

AIVA، ملحن الموسيقى المعتمد على الذكاء الاصطناعي، يصنع مقاطع موسيقية مخصصة تناسب تفضيلاتك الفريدة. سواء كنت بحاجة إلى إلهام لمشروع ما أو قطعة خاصة لمناسبة مميزة، فإن AIVA يحوّل رؤيتك الموسيقية إلى واقع.

Find AI tools in YBX

Related Articles

Refresh Articles