MetaがGPT-4V競合のテストを開始:レイバンスマートグラスに搭載された新しいマルチモーダルAI

Most people like

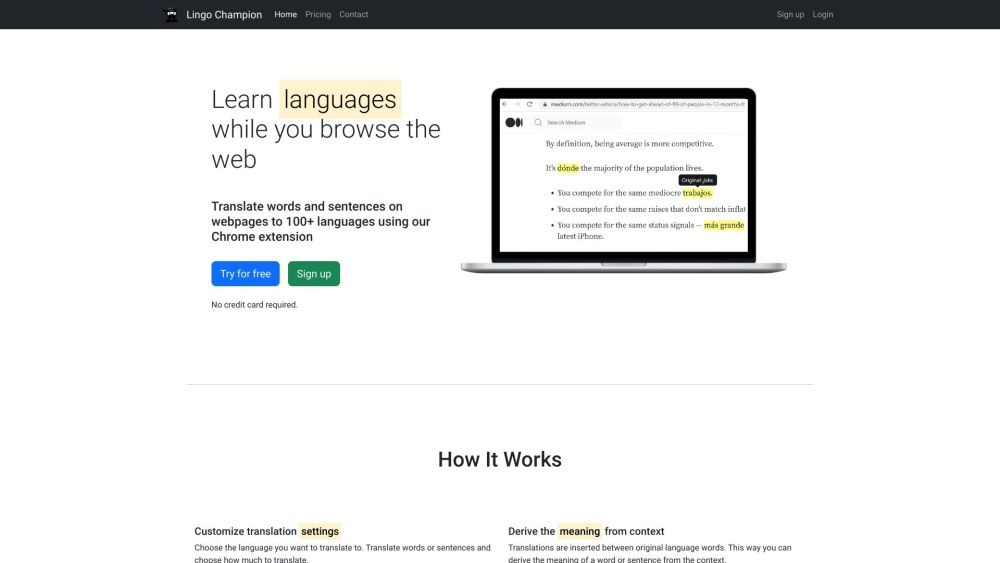

Lingo Championとともに、ウェブをブラウジングしながら、 effortless に言語学習の喜びを発見しましょう!オンライン体験を中断することなく、リアルタイムでスキルを向上させます。

Mindgrasp AIは、様々なコンテンツ形式から正確なノートやクイズを生成し、学習と生産性を向上させます。この革新的なツールは、複雑な情報を消化しやすい形式に変えることで、学習プロセスを簡素化し、記憶の定着を強化します。

Find AI tools in YBX

Related Articles

Refresh Articles